AI 與 Markdown:為什麼它對 LLM 工作流程不可或缺

只要在 AI 工具周圍待上一段時間,一個規律就會浮現出來:提示詞、模型卡片、檢索用的來源文件以及資料集標註,用 Markdown 編寫的頻率遠高於 PDF 或 Word。這不僅僅是開發者的習慣。Markdown 的純文字結構、清晰的語意表達和廣泛的相容性,使它天然地處在人類可讀內容與機器可處理數據之間的銜接位置。

本文將解釋為什麼 Markdown 適合 AI 和 LLM 內容,以及如何對其進行結構化,以在語言模型上獲得更好的結果。

理解基礎概念

Markdown 的優勢在於簡潔。它被設計為一種輕量級標記語言,原始形式下就便於閱讀,同時能乾淨地轉換為 HTML。對於 AI 應用而言,正是這種結構化的簡潔性讓它如此有用。

純文字對機器學習的意義

與 PDF 或 DOCX 等二進位格式不同,Markdown 檔案是純文字。這對 AI 工作流程有著實實在在的影響:

- 直接攝取:Markdown 可以無需任何擷取或預處理步驟就直接輸入語言模型。

- 版本控制:Git 能乾淨地處理基於文字的差異對比,這對協作資料集和提示詞庫非常重要。

- 輕量儲存:同一份文件以 Markdown 儲存,會比 Word 或 PDF 檔案小得多。

- 通用相容:任何系統或工具都能讀取它。

對於訓練和檢索流水線來說,這種簡潔性消除了一整類問題——無需專有解析器,也不會出現掃描版 PDF 帶來的擷取錯誤。

語意結構

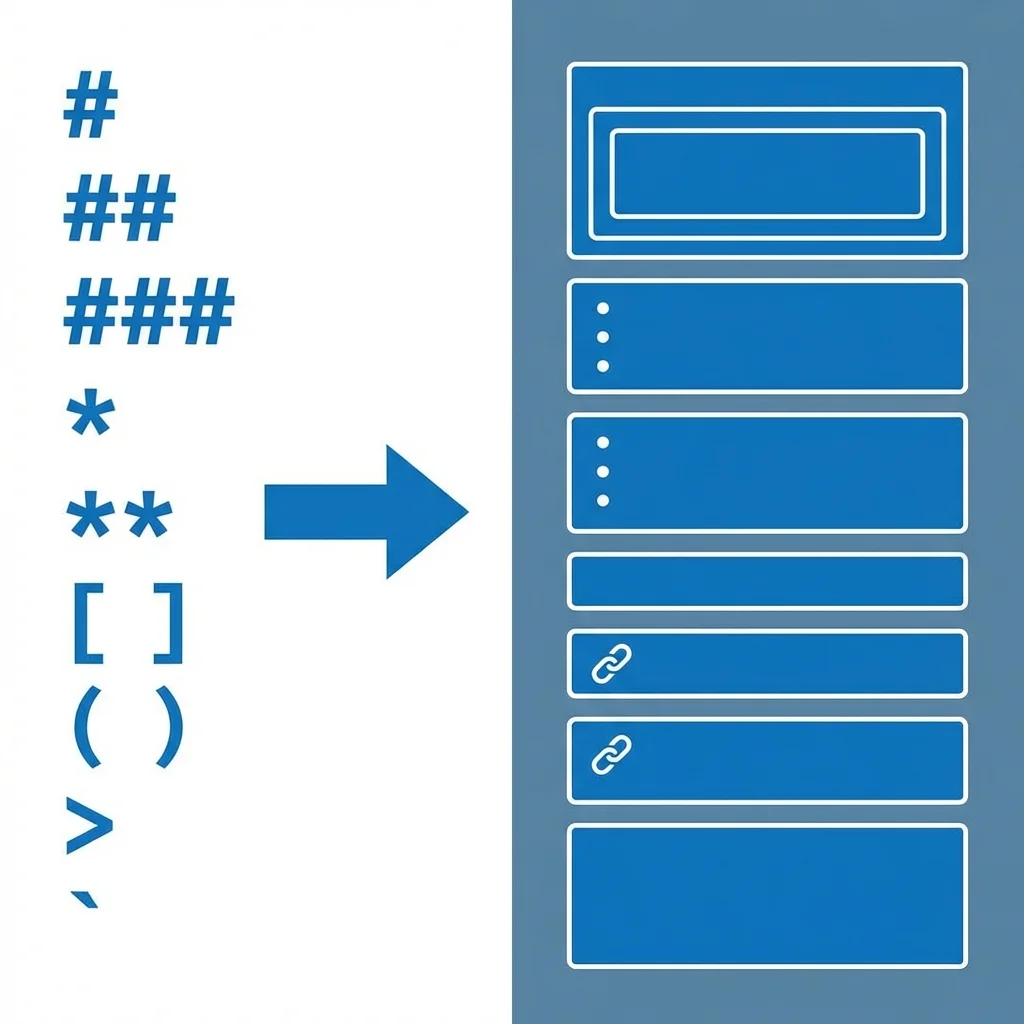

讓 Markdown 在 AI 應用中脫穎而出的,是它的語意元素。標題(#、##、###)建立清晰的層次結構,清單將相關條目歸為一組,程式碼區塊隔離技術內容。這些是結構訊號,而不僅僅是視覺格式。

看看這個例子:

## Training Configuration

- Model: transformer-based

- Dataset size: 10M tokens

- Batch size: 32

### Hyperparameters

| Parameter | Value |

|-----------|-------|

| Learning rate | 0.001 |

| Epochs | 50 |

標題標記主題邊界,清單呈現順序資訊,表格承載結構化數據。讀取這段內容的模型獲得了關於內容如何組織的明確線索,而無需僅憑散文來推斷結構。

語言模型如何處理結構化內容

語言模型在處理文字之前會先將其分解為 token。Markdown 的分隔符號——表示強調的星號、表示標題的井號、表示程式碼的反引號——在這個 token 流中是一致且可預測的標記。

作為訊號的結構

像 ## Hyperparameters 這樣的標題,是一個清晰、一致的標記,表明一個新章節正在開始。主流模型供應商的提示詞工程指南——OpenAI 和 Anthropic 都是如此——都建議向模型提供清晰分隔、結構良好的輸入。Markdown 正是實現這一點的一種簡單方式。

在實踐中,結構良好的輸入往往有助於:

- 保持主題:清晰的章節讓模型更容易將回應控制在範圍之內。

- 保持上下文:標題在長文件中充當錨點。

- 遵循指令:把「上下文」和「要求」分開能減少歧義。

這些是傾向,而非保證——結構有幫助,但它無法取代一個寫得好的提示詞。

層次結構與注意力

Transformer 模型會權衡輸入的哪些部分與任務最相關。一致的 H1 → H2 → H3 層次結構,相比未經區分的大段文字,能為這一過程提供一張更清晰的文件地圖。

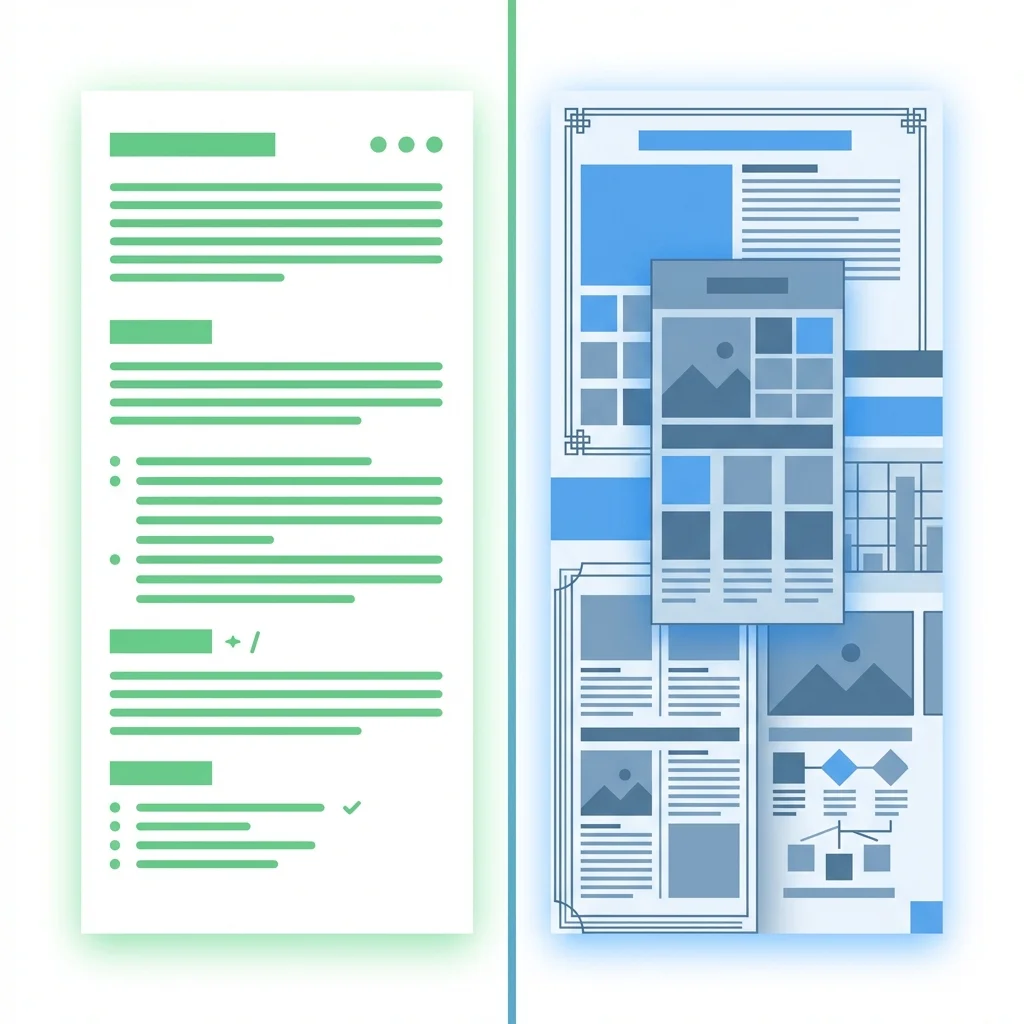

格式對比

Markdown 並非適合每一項工作,但在 AI 工作流程方面,它相比傳統文件格式有著明顯優勢。下表總結了大致的權衡:

| 格式 | 可編輯性 | Token 效率 | 版本控制 | AI 處理便利性 |

|---|---|---|---|---|

| Markdown | 高 | 高 | 原生(純文字) | 直接處理 |

| 低 | 低 | 困難 | 需要擷取 | |

| DOCX | 中等 | 低 | 困難(二進位) | 需要擷取 |

| HTML | 中等 | 中等 | 可行 | 可直接處理,但冗長 |

核心要點是可靠性。二進位格式需要一個擷取步驟,而正是這個步驟會悄悄引入解析錯誤——這些錯誤可能損壞訓練數據,或向模型輸入亂碼。

權衡取捨

Markdown 確實有局限:不原生支援複雜版面,嵌入媒體需要外部檔案,樣式也很簡單。對於 AI 工作來說,這種極簡大多是一種優勢——內容能始終聚焦於實質。當您需要一份精美的交付成果時,像我們的 Markdown 轉 Word 工具這樣的工具能讓您用 Markdown 起草,然後匯出為專業格式。

適用於 AI 內容的實用 Markdown 功能

在處理語言模型時,有幾個 Markdown 功能尤其有用。

用於結構化數據的表格

Markdown 表格以模型可以直接推理的形式呈現表格資訊:

| Model | Context window | Structured input |

|-------|----------------|-------------------|

| Example A | Large | Handled well |

| Example B | Very large | Handled well |

這比用散文描述相同數據更清晰——模型可以提取特定值並對行進行比較。保持表格適度簡短,使其不會佔滿上下文視窗。

用於技術內容的程式碼區塊

圍欄程式碼區塊將程式碼與周圍文字隔離:

```python

def train_model(data, epochs=50):

# Training logic here

return model

```

三個反引號的圍欄可以防止模型把程式碼標點誤讀為敘述內容——這在生成程式碼或記錄 API 時很重要。

用於順序資訊的清單

有序清單和無序清單表示不同的關係:

- 無序清單(

-或*)用於概念或功能的集合 - 有序清單(

1.、2.)用於按順序發生的步驟

讓清單類型與內容相匹配,有助於模型按預期的順序遵循指令。

在 AI 工作流程中使用 Markdown

資料集準備

從一開始就用 Markdown 來組織標註資料,能讓它保持可讀且易於編輯:

- 用標題分隔類別或範例。

- 用清單處理多輪對話或順序數據。

- 當您需要不應出現在可見文字中的元數據時,把隱藏的上下文放在 HTML 註釋(

<!-- key: value -->)裡。

對於許多標註任務來說,這比原始的 JSON 或 CSV 更易於編寫和審閱。

提示詞工程

Markdown 賦予提示詞範本清晰的形態:

## Task: Summarize the following article

### Context

[Article text here]

### Requirements

- Length: 3-5 sentences

- Focus on key findings

- Maintain an objective tone

把任務、上下文和要求分隔成帶標籤的章節,能讓模型更容易解析這些指令。

文件與模型卡片

Markdown 是模型文件的標準——Hugging Face 的模型卡片就是用它編寫的。它讓您能把表格中的規格、程式碼區塊中的範例、說明性散文以及連結形式的引用,全部組合在一個對 Git 友善的原始檔案裡。

優化技巧

保持標題層級一致

漸進地使用標題——不要從 H1 跳到 H3。一致的層次結構能讓文件結構清晰無歧義。像 markdownlint 這樣的檢查工具可以在 CI 流水線中自動強制執行這一點。

轉義特殊字元

轉義那些原本會被解釋為語法的字元:

Use `\*` to display an asterisk literally

這能避免模型——或下游解析器——誤讀該符號的情況。

管理上下文視窗

LLM 有 token 限制。保持 Markdown 文件的模組化:把長檔案拆分為可以獨立處理的章節,而不是依賴一個過大的檔案。

應避免的常見陷阱

有幾個反覆出現的錯誤值得留意:

- 空白不一致:混用 Tab 和空格可能會破壞某些解析器。

- 過度巢狀:巢狀超過三四層的清單會變得難以理解——對模型和人都是如此。

- 未轉義字元:驗證程式碼區塊,以免散落的符號改變解析結果。

- 風格不相符:堅持使用受廣泛支援的變體——CommonMark 規範和 GitHub 風格 Markdown是最穩妥的基準。

在大規模執行前用幾個樣本輸入進行測試,能盡早發現其中大部分問題。

Markdown 的發展方向

Markdown 在不斷吸納 AI 工作的需求。Mermaid 語法以文字形式表示圖表,YAML 前置元數據在不讓正文變得雜亂的情況下承載元數據。兩者都讓文件保持在單個純文字檔案中,從而便於做差異對比、便於處理。

何時應使用其他格式

Markdown 並非總是答案。高度視覺化的內容用 HTML 可能更好。結構化數據交換通常用 JSON 更合適。而對於需要精確格式的最終交付成果,請轉換為 Word 或 PDF——我們的免費轉換工具能處理這一步。

把 Markdown 用在它真正擅長的地方:起草、協作、版本控制,以及向語言模型輸入結構化內容。

立即開始

如果 Markdown 還不是您 AI 工作流程的一部分,從小處著手:

- 用 Markdown 而非純文字來編寫您的下一個提示詞範本。

- 用標題和清單來組織一個小型資料集。

- 用您常用的模型執行它,並將結果與非結構化版本進行對比。

熟悉之後,在有幫助的地方加入表格、程式碼區塊和元數據。

對於正在擺脫傳統格式的團隊,混合方法效果很好:用 Markdown 起草以獲得速度和協作便利,然後轉換為精美格式用於交付。我們的部落格有更多關於該工作流程的教學。

總結

Markdown 在 AI 和機器學習中的流行,源於貫穿整個開發生命週期、不斷累積的實際優勢:純文字的簡潔性、語意結構和通用相容性。對於訓練數據、提示詞範本和模型文件來說,它是一種可靠、低摩擦的格式。

學習曲線很小。用 Markdown 組織一個專案,將它與您目前的做法對比,然後讓結果來做決定。

覺得好用?分享給更多朋友吧!