AI 与 Markdown:为什么它对 LLM 工作流不可或缺

只要在 AI 工具周围待上一段时间,一个规律就会浮现出来:提示词、模型卡片、检索用的源文档以及数据集标注,用 Markdown 编写的频率远高于 PDF 或 Word。这不仅仅是开发者的习惯。Markdown 的纯文本结构、清晰的语义表达和广泛的兼容性,使它天然地处在人类可读内容与机器可处理数据之间的衔接位置。

本文将解释为什么 Markdown 适合 AI 和 LLM 内容,以及如何对其进行结构化以在语言模型上获得更好的结果。

理解基础概念

Markdown 的优势在于简洁。它被设计为一种轻量级标记语言,原始形式下就便于阅读,同时能干净地转换为 HTML。对于 AI 应用而言,正是这种结构化的简洁性让它如此有用。

纯文本对机器学习的意义

与 PDF 或 DOCX 等二进制格式不同,Markdown 文件是纯文本。这对 AI 工作流有着实实在在的影响:

- 直接处理:Markdown 可以无需任何提取或预处理步骤就直接输入语言模型。

- 版本控制:Git 能干净地处理基于文本的差异对比,这对协作数据集和提示词库非常重要。

- 轻量存储:同一份文档以 Markdown 保存,会比 Word 或 PDF 文件小得多。

- 通用兼容:任何系统或工具都能读取它。

对于训练和检索流水线来说,这种简洁性消除了一整类问题——无需专有解析器,也不会出现扫描版 PDF 带来的提取错误。

语义结构

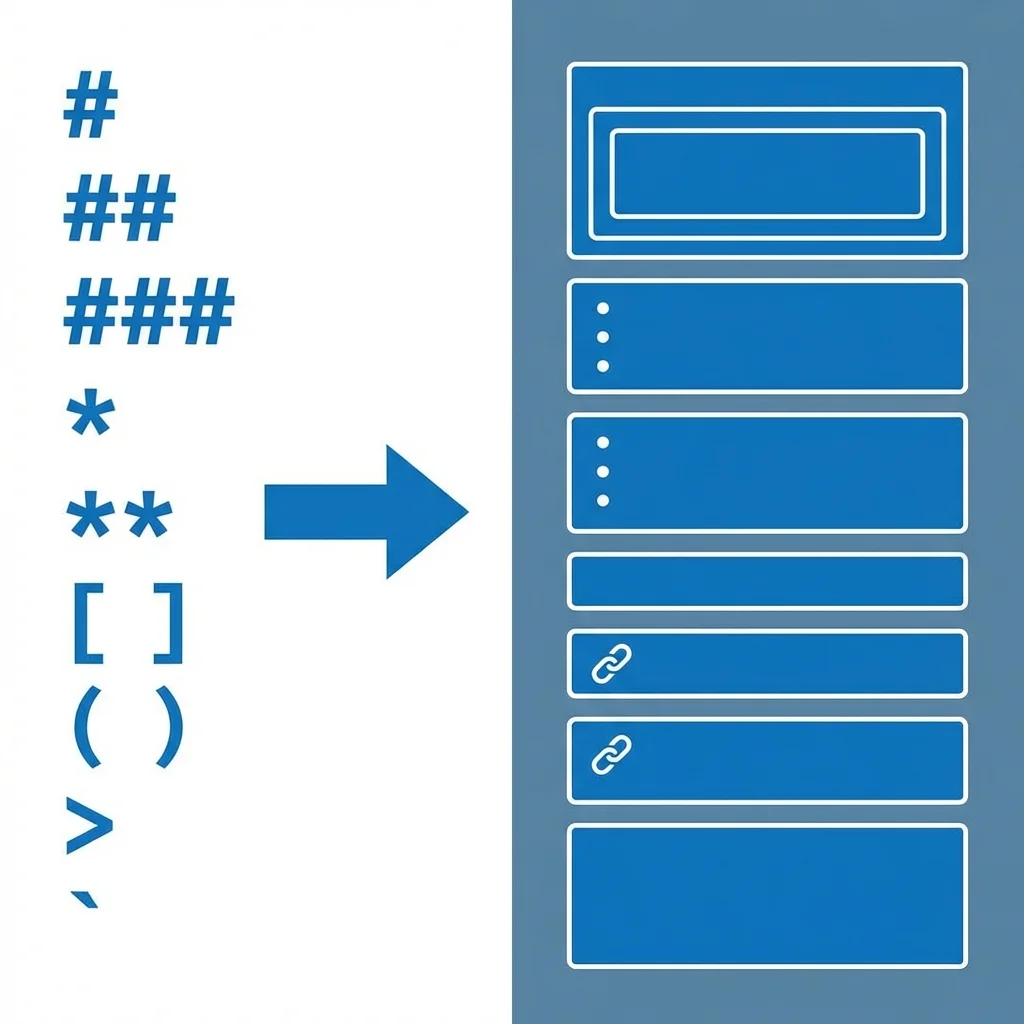

让 Markdown 在 AI 应用中脱颖而出的,是它的语义元素。标题(#、##、###)创建清晰的层次结构,列表将相关条目归为一组,代码块隔离技术内容。这些是结构信号,而不仅仅是视觉格式。

看看这个例子:

## Training Configuration

- Model: transformer-based

- Dataset size: 10M tokens

- Batch size: 32

### Hyperparameters

| Parameter | Value |

|-----------|-------|

| Learning rate | 0.001 |

| Epochs | 50 |

标题标记主题边界,列表呈现顺序信息,表格承载结构化数据。读取这段内容的模型获得了关于内容如何组织的明确线索,而无需仅凭散文来推断结构。

语言模型如何处理结构化内容

语言模型在处理文本之前会先将其分解为 token。Markdown 的分隔符——表示强调的星号、表示标题的井号、表示代码的反引号——在这个 token 流中是一致且可预测的标记。

作为信号的结构

像 ## Hyperparameters 这样的标题,是一个清晰、一致的标记,表明一个新章节正在开始。主流模型提供商的提示词工程指南——OpenAI 和 Anthropic 都是如此——都建议向模型提供清晰分隔、结构良好的输入。Markdown 正是实现这一点的一种简单方式。

在实践中,结构良好的输入往往有助于:

- 保持主题:清晰的章节让模型更容易将回应控制在范围之内。

- 保持上下文:标题在长文档中充当锚点。

- 遵循指令:把"上下文"和"要求"分开能减少歧义。

这些是倾向,而非保证——结构有帮助,但它无法替代一个写得好的提示词。

层次结构与注意力

Transformer 模型会权衡输入的哪些部分与任务最相关。一致的 H1 → H2 → H3 层次结构,相比未经区分的大段文字,能为这一过程提供一张更清晰的文档地图。

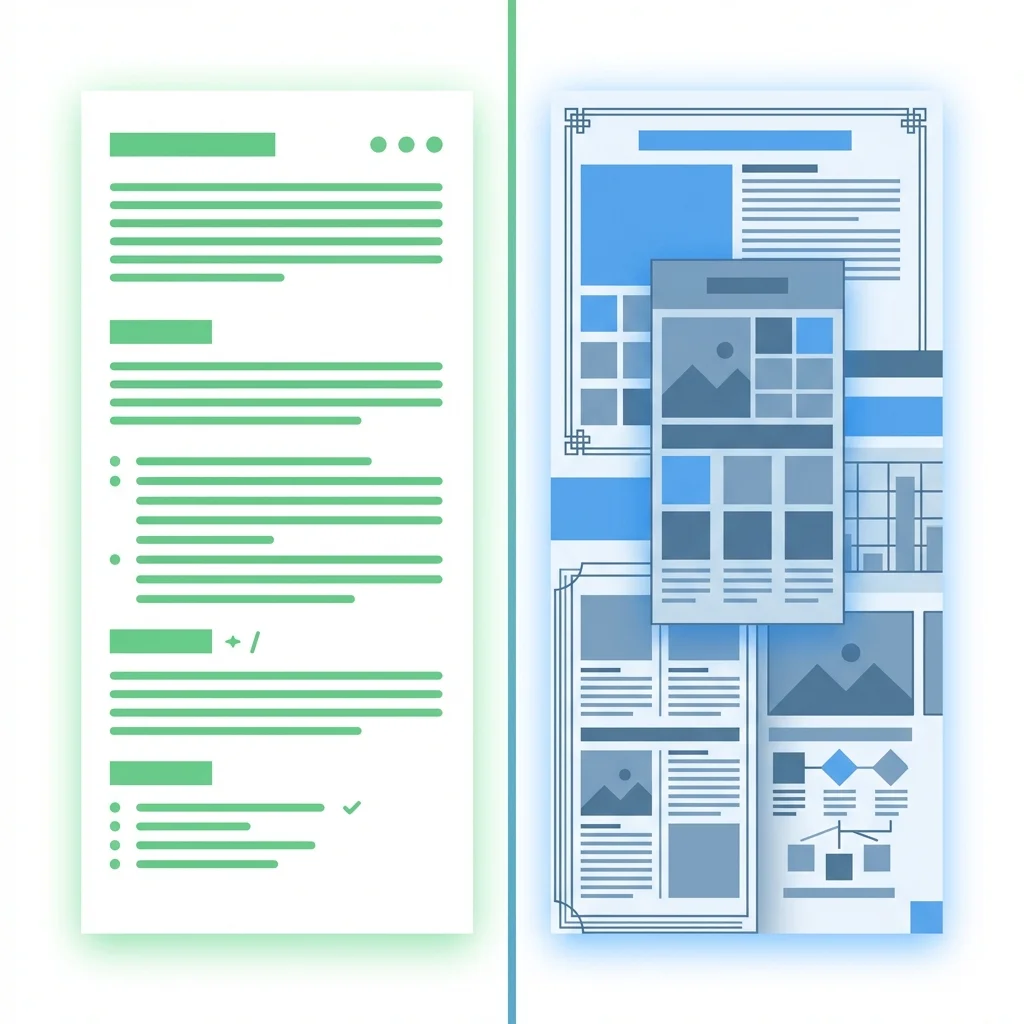

格式对比

Markdown 并非适合每一项工作,但在 AI 工作流方面,它相比传统文档格式有着明显优势。下表总结了大致的权衡:

| 格式 | 可编辑性 | Token 效率 | 版本控制 | AI 处理便利性 |

|---|---|---|---|---|

| Markdown | 高 | 高 | 原生(纯文本) | 直接处理 |

| 低 | 低 | 困难 | 需要提取 | |

| DOCX | 中等 | 低 | 困难(二进制) | 需要提取 |

| HTML | 中等 | 中等 | 可行 | 可直接处理,但冗长 |

核心要点是可靠性。二进制格式需要一个提取步骤,而正是这个步骤会悄悄引入解析错误——这些错误可能损坏训练数据,或向模型输入乱码。

权衡取舍

Markdown 确实有局限:不原生支持复杂布局,嵌入媒体需要外部文件,样式也很简单。对于 AI 工作来说,这种极简大多是一种优势——内容能始终聚焦于实质。当你需要一份精美的交付成果时,像我们的 Markdown 转 Word 工具这样的工具能让你用 Markdown 起草,然后导出为专业格式。

适用于 AI 内容的实用 Markdown 功能

在处理语言模型时,有几个 Markdown 功能尤其有用。

用于结构化数据的表格

Markdown 表格以模型可以直接推理的形式呈现表格信息:

| Model | Context window | Structured input |

|-------|----------------|-------------------|

| Example A | Large | Handled well |

| Example B | Very large | Handled well |

这比用散文描述相同数据更清晰——模型可以提取特定值并对行进行比较。保持表格适度简短,使其不会占满上下文窗口。

用于技术内容的代码块

围栏代码块将代码与周围文本隔离:

```python

def train_model(data, epochs=50):

# Training logic here

return model

```

三个反引号的围栏可以防止模型把代码标点误读为叙述内容——这在生成代码或记录 API 时很重要。

用于顺序信息的列表

有序列表和无序列表表示不同的关系:

- 无序列表(

-或*)用于概念或功能的集合 - 有序列表(

1.、2.)用于按顺序发生的步骤

让列表类型与内容相匹配,有助于模型按预期的顺序遵循指令。

在 AI 工作流中使用 Markdown

数据集准备

从一开始就用 Markdown 来组织标注数据,能让它保持可读且易于编辑:

- 用标题分隔类别或示例。

- 用列表处理多轮对话或顺序数据。

- 当你需要不应出现在可见文本中的元数据时,把隐藏的上下文放在 HTML 注释(

<!-- key: value -->)里。

对于许多标注任务来说,这比原始的 JSON 或 CSV 更易于编写和审阅。

提示词工程

Markdown 赋予提示词模板清晰的形态:

## Task: Summarize the following article

### Context

[Article text here]

### Requirements

- Length: 3-5 sentences

- Focus on key findings

- Maintain an objective tone

把任务、上下文和要求分隔成带标签的章节,能让模型更容易解析这些指令。

文档与模型卡片

Markdown 是模型文档的标准——Hugging Face 的模型卡片就是用它编写的。它让你能把表格中的规格、代码块中的示例、说明性散文以及链接形式的引用,全部组合在一个对 Git 友好的源文件里。

优化技巧

保持标题层级一致

渐进地使用标题——不要从 H1 跳到 H3。一致的层次结构能让文档结构清晰无歧义。像 markdownlint 这样的检查工具可以在 CI 流水线中自动强制执行这一点。

转义特殊字符

转义那些原本会被解释为语法的字符:

Use `\*` to display an asterisk literally

这能避免模型——或下游解析器——误读该符号的情况。

管理上下文窗口

LLM 有 token 限制。保持 Markdown 文档的模块化:把长文件拆分为可以独立处理的章节,而不是依赖一个过大的文件。

应避免的常见陷阱

有几个反复出现的错误值得留意:

- 空白不一致:混用制表符和空格可能会破坏某些解析器。

- 过度嵌套:嵌套超过三四层的列表会变得难以理解——对模型和人都是如此。

- 未转义字符:验证代码块,以免散落的符号改变解析结果。

- 风格不匹配:坚持使用受广泛支持的变体——CommonMark 规范和 GitHub 风格 Markdown是最稳妥的基准。

在大规模运行前用几个样本输入进行测试,能尽早发现其中大部分问题。

Markdown 的发展方向

Markdown 在不断吸纳 AI 工作的需求。Mermaid 语法以文本形式表示图表,YAML 前置元数据在不让正文变得杂乱的情况下承载元数据。两者都让文档保持在单个纯文本文件中,从而便于做差异对比、便于处理。

何时应使用其他格式

Markdown 并非总是答案。高度视觉化的内容用 HTML 可能更好。结构化数据交换通常用 JSON 更合适。而对于需要精确格式的最终交付成果,请转换为 Word 或 PDF——我们的免费转换工具能处理这一步。

把 Markdown 用在它真正擅长的地方:起草、协作、版本控制,以及向语言模型输入结构化内容。

立即开始

如果 Markdown 还不是你 AI 工作流的一部分,从小处着手:

- 用 Markdown 而非纯文本来编写你的下一个提示词模板。

- 用标题和列表来组织一个小型数据集。

- 用你常用的模型运行它,并将结果与非结构化版本进行对比。

熟悉之后,在有帮助的地方加入表格、代码块和元数据。

对于正在摆脱传统格式的团队,混合方法效果很好:用 Markdown 起草以获得速度和协作便利,然后转换为精美格式用于交付。我们的博客有更多关于该工作流的教程。

总结

Markdown 在 AI 和机器学习中的流行,源于贯穿整个开发生命周期、不断累积的实际优势:纯文本的简洁性、语义结构和通用兼容性。对于训练数据、提示词模板和模型文档来说,它是一种可靠、低摩擦的格式。

学习曲线很小。用 Markdown 组织一个项目,将它与你当前的做法对比,然后让结果来做决定。

觉得好用?分享给更多朋友吧!