Markdown для ИИ: почему он необходим для рабочих процессов LLM

Достаточно немного поработать рядом с инструментами для ИИ, чтобы заметить закономерность: промпты, карточки моделей, исходные документы для извлечения (retrieval) и аннотации наборов данных гораздо чаще пишутся в Markdown, чем в PDF или Word. И это не просто привычка разработчиков. Структура Markdown на основе простого текста, его семантическая ясность и универсальная совместимость делают его естественным связующим звеном между контентом, читаемым человеком, и данными, обрабатываемыми машиной.

Это руководство объясняет, почему Markdown хорошо подходит для контента ИИ и LLM и как структурировать его для получения лучших результатов с языковыми моделями.

Понимание основ

Сила Markdown — в его простоте. Он был создан как легковесный язык разметки, призванный быть читаемым в исходном виде и при этом чисто конвертироваться в HTML. Для приложений ИИ именно эта структурированная простота и делает его полезным.

Почему простой текст важен для машинного обучения

В отличие от бинарных форматов, таких как PDF или DOCX, файл Markdown — это чистый текст. Это имеет реальные последствия для рабочих процессов ИИ:

- Прямая загрузка: Markdown можно передать языковой модели без какого-либо шага извлечения или предварительной обработки.

- Контроль версий: Git чисто обрабатывает текстовые различия (diffs), что важно для совместных наборов данных и библиотек промптов.

- Легковесное хранение: один и тот же документ занимает гораздо меньше места в Markdown, чем в виде файла Word или PDF.

- Универсальная совместимость: любая система или инструмент может его прочитать.

Для конвейеров обучения и извлечения эта простота устраняет целый класс проблем — никаких проприетарных парсеров, никаких ошибок извлечения из отсканированных PDF.

Семантическая структура

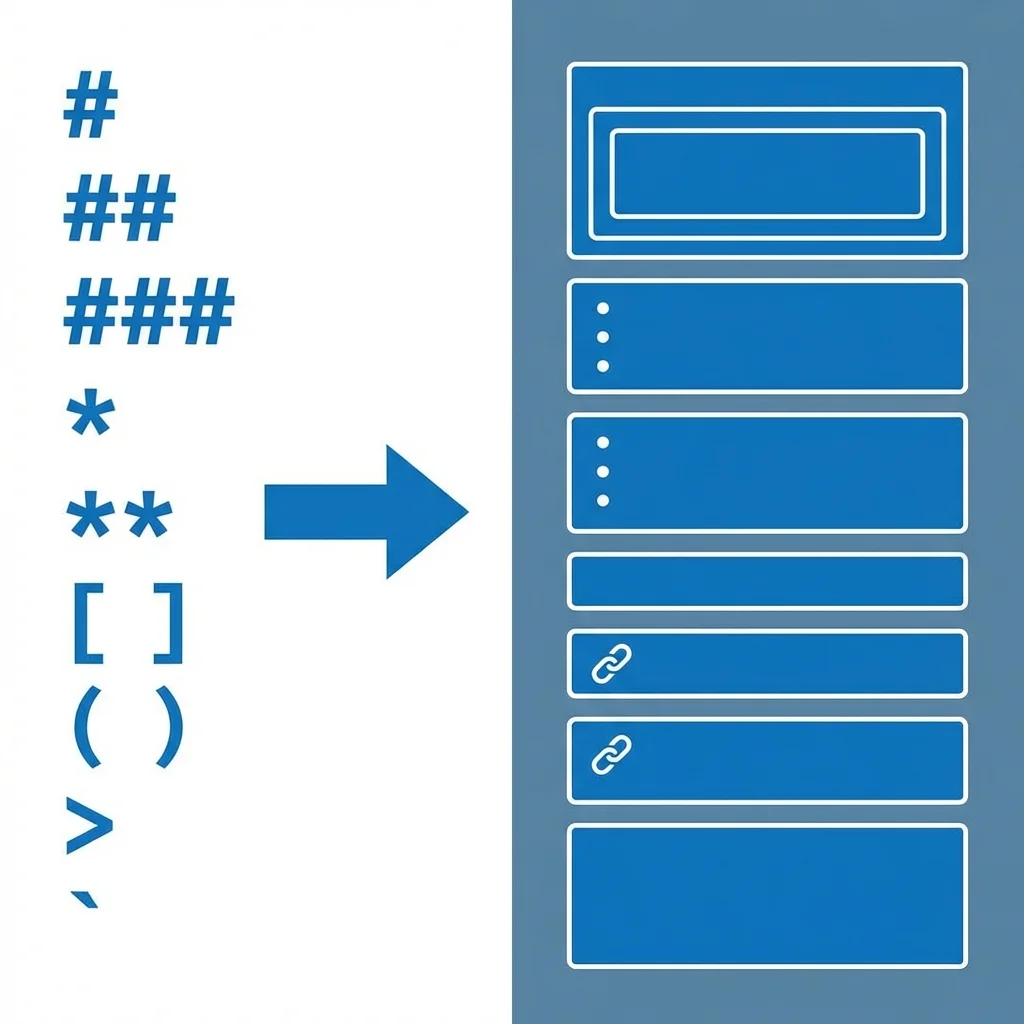

Что выделяет Markdown для ИИ — это его семантические элементы. Заголовки (#, ##, ###) создают четкую иерархию, списки группируют связанные элементы, а блоки кода изолируют технический контент. Это структурные сигналы, а не просто визуальное форматирование.

Рассмотрим такой пример:

## Training Configuration

- Model: transformer-based

- Dataset size: 10M tokens

- Batch size: 32

### Hyperparameters

| Parameter | Value |

|-----------|-------|

| Learning rate | 0.001 |

| Epochs | 50 |

Заголовки обозначают границы тем, список представляет последовательную информацию, а таблица содержит структурированные данные. Модель, читающая это, получает явные подсказки о том, как организован контент, вместо того чтобы выводить структуру только из прозы.

Как языковые модели обрабатывают структурированный контент

Языковые модели разбивают текст на токены перед его обработкой. Разделители Markdown — звездочки для выделения, решетки для заголовков, обратные кавычки для кода — это согласованные, предсказуемые маркеры внутри этого потока токенов.

Структура как сигнал

Заголовок вроде ## Hyperparameters — это четкий, согласованный маркер того, что начинается новый раздел. Рекомендации по промпт-инжинирингу от ведущих поставщиков моделей — как OpenAI, так и Anthropic — советуют давать моделям четко разграниченный, хорошо структурированный ввод. Markdown — один из простых способов сделать это.

На практике хорошо структурированный ввод обычно помогает с:

- Удержанием темы: четкие разделы упрощают модели задачу сохранять ответ в рамках темы.

- Сохранением контекста: заголовки служат якорями в длинных документах.

- Следованием инструкциям: разделение «контекста» и «требований» снижает неоднозначность.

Это тенденции, а не гарантии — структура помогает, но не заменяет хорошо написанный промпт.

Иерархия и внимание

Модели-трансформеры взвешивают, какие части ввода наиболее релевантны задаче. Согласованная иерархия H1 → H2 → H3 дает этому процессу более четкую карту документа, чем недифференцированная стена текста.

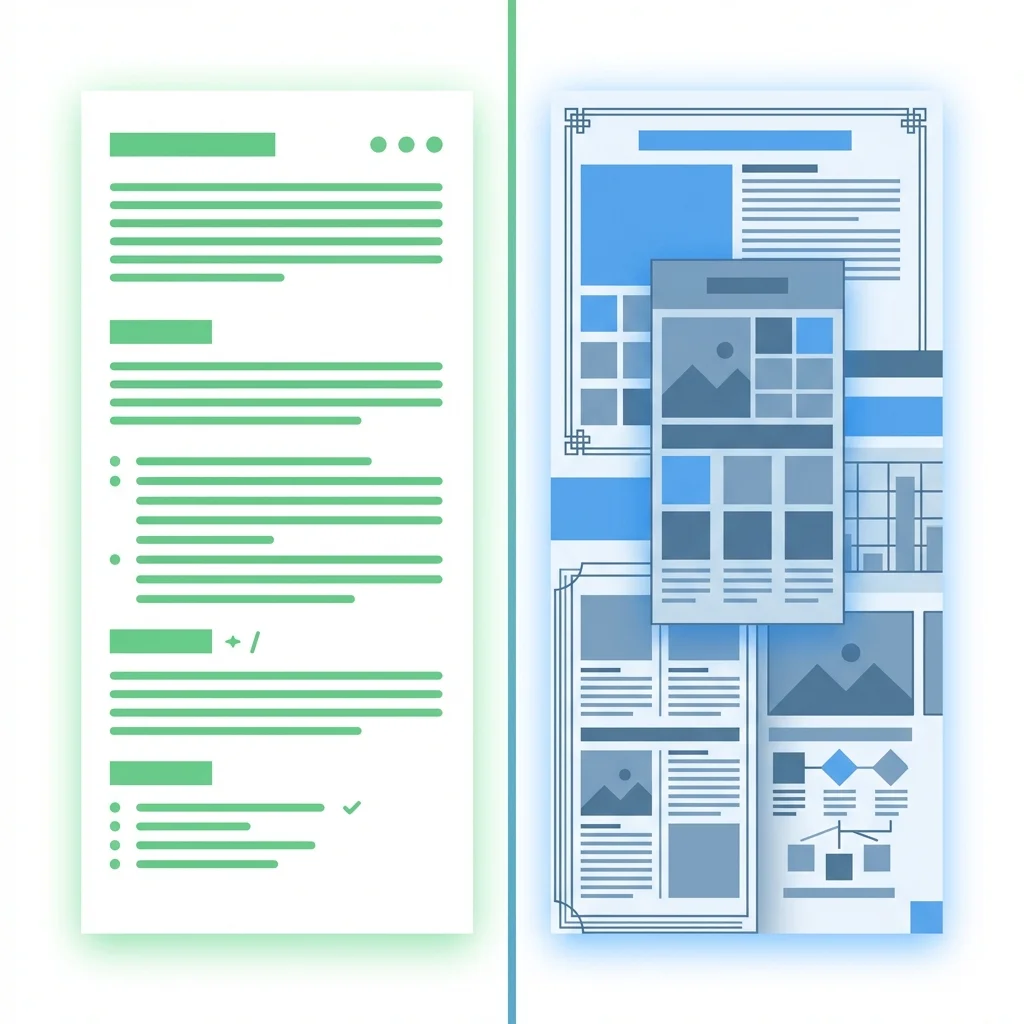

Сравнение форматов

Markdown — не лучший выбор для каждой задачи, но для рабочих процессов ИИ у него есть явные преимущества перед традиционными форматами документов. В таблице ниже обобщены общие компромиссы:

| Формат | Редактируемость | Эффективность токенов | Контроль версий | Простота загрузки в ИИ |

|---|---|---|---|---|

| Markdown | Высокая | Высокая | Нативный (простой текст) | Прямая |

| Низкая | Низкая | Сложный | Требует извлечения | |

| DOCX | Средняя | Низкая | Сложный (бинарный) | Требует извлечения |

| HTML | Средняя | Средняя | Приемлемый | Прямая, но многословная |

Главное здесь — надежность. Бинарные форматы требуют шага извлечения, и именно на этом шаге проникают ошибки парсинга — ошибки, способные повредить обучающие данные или передать модели искаженный ввод.

Компромиссы

У Markdown все же есть ограничения: нет нативной поддержки сложных макетов, встроенные медиа требуют внешних файлов, а возможности стилизации минимальны. Для работы с ИИ этот минимализм по большей части является преимуществом — контент остается сосредоточенным на сути. Когда вам нужен отполированный итоговый результат, такой инструмент, как наш конвертер Markdown в Word, позволяет писать черновик в Markdown и экспортировать его в профессиональный формат.

Практические возможности Markdown для контента ИИ

Несколько возможностей Markdown особенно полезны при работе с языковыми моделями.

Таблицы для структурированных данных

Таблица Markdown представляет табличную информацию в форме, с которой модель может работать напрямую:

| Model | Context window | Structured input |

|-------|----------------|-------------------|

| Example A | Large | Handled well |

| Example B | Very large | Handled well |

Это понятнее, чем описывать те же данные прозой — модель может извлекать конкретные значения и сравнивать строки. Делайте таблицы достаточно короткими, чтобы они не доминировали в контекстном окне.

Блоки кода для технического контента

Огороженные блоки кода изолируют код от окружающего текста:

```python

def train_model(data, epochs=50):

# Training logic here

return model

```

Ограждение из трех обратных кавычек не дает модели ошибочно принять пунктуацию кода за повествование — это важно при генерации кода или документировании API.

Списки для последовательной информации

Упорядоченные и неупорядоченные списки сигнализируют о разных отношениях:

- Неупорядоченные списки (

-или*) для наборов концепций или функций - Упорядоченные списки (

1.,2.) для шагов, выполняемых последовательно

Соответствие типа списка содержанию помогает модели следовать инструкциям в нужном порядке.

Использование Markdown в рабочем процессе ИИ

Подготовка датасетов

Структурирование данных аннотаций в Markdown с самого начала сохраняет их читаемыми и редактируемыми:

- Используйте заголовки для разделения категорий или примеров.

- Используйте списки для многоходовых диалогов или последовательных данных.

- Храните скрытый контекст в HTML-комментариях (

<!-- key: value -->), когда нужны метаданные, которые не должны появляться в видимом тексте.

Для многих задач аннотирования это проще писать и проверять, чем сырой JSON или CSV.

Промпт-инжиниринг

Markdown придает шаблонам промптов четкую форму:

## Task: Summarize the following article

### Context

[Article text here]

### Requirements

- Length: 3-5 sentences

- Focus on key findings

- Maintain an objective tone

Разделение задачи, контекста и требований на помеченные разделы делает инструкции более удобными для разбора моделью.

Документация и карточки моделей

Markdown — это стандарт для документации моделей: карточки моделей Hugging Face написаны на нем. Он позволяет объединять спецификации в таблицах, примеры в блоках кода, пояснительную прозу и цитаты в виде ссылок — все это в одном исходном файле, удобном для Git.

Советы по оптимизации

Сохраняйте уровни заголовков согласованными

Используйте заголовки последовательно — не перескакивайте с H1 на H3. Согласованная иерархия делает структуру документа однозначной. Линтер вроде markdownlint может автоматически применять это правило в конвейере CI.

Экранируйте специальные символы

Экранируйте символы, которые иначе были бы интерпретированы как синтаксис:

Use `\*` to display an asterisk literally

Это исключает случаи, когда модель — или последующий парсер — неверно интерпретирует символ.

Управляйте контекстным окном

У LLM есть лимиты токенов. Делайте документы Markdown модульными: разбивайте длинные файлы на разделы, которые можно обрабатывать независимо, вместо того чтобы полагаться на один чрезмерно большой файл.

Распространенные ошибки, которых следует избегать

Несколько повторяющихся ошибок заслуживают внимания:

- Несогласованные пробелы: смешивание табуляций и пробелов может ломать некоторые парсеры.

- Чрезмерная вложенность: списки глубже трех-четырех уровней становятся трудными для восприятия — как для моделей, так и для людей.

- Неэкранированные символы: проверяйте блоки кода, чтобы случайные символы не меняли результат парсинга.

- Несовместимость диалектов: придерживайтесь широко поддерживаемого варианта — спецификация CommonMark и GitHub Flavored Markdown являются самыми безопасными базовыми вариантами.

Тестирование на нескольких образцах ввода перед крупным запуском позволяет заранее выявить большинство таких проблем.

Куда движется Markdown

Markdown продолжает вбирать в себя потребности работы с ИИ. Синтаксис Mermaid представляет диаграммы в виде текста, а YAML frontmatter несет метаданные, не загромождая основную часть документа. Оба подхода сохраняют документы в одном файле простого текста, который остается удобным для сравнения (diff-able) и легким для обработки.

Когда использовать что-то другое

Markdown не всегда является ответом. Сильно визуальный контент может быть лучше представлен в HTML. Обмен структурированными данными обычно лучше делать через JSON. А для финального результата, требующего точного форматирования, конвертируйте в Word или PDF — наш бесплатный конвертер выполняет этот шаг.

Используйте Markdown там, где он действительно силен: черновики, совместная работа, контроль версий и передача структурированного контента языковым моделям.

С чего начать

Если Markdown еще не часть вашего рабочего процесса ИИ, начните с малого:

- Напишите свой следующий шаблон промпта в Markdown вместо простого текста.

- Структурируйте небольшой датасет с помощью заголовков и списков.

- Прогоните его через вашу обычную модель и сравните результаты с неструктурированной версией.

По мере того как вы освоитесь, добавляйте таблицы, блоки кода и метаданные там, где они помогают.

Для команд, отходящих от традиционных форматов, хорошо работает гибридный подход: пишите черновик в Markdown ради скорости и совместной работы, затем конвертируйте в отполированный формат для передачи. В нашем блоге есть больше руководств по этому рабочему процессу.

Заключение

Популярность Markdown в ИИ и машинном обучении обусловлена практическими преимуществами, которые накапливаются на протяжении всего жизненного цикла разработки: простота простого текста, семантическая структура и универсальная совместимость. Для обучающих данных, шаблонов промптов и документации моделей это надежный формат с низким уровнем трения.

Кривая обучения невелика. Структурируйте один проект в Markdown, сравните его с вашим текущим подходом и пусть результаты решат сами.

Нашли этот инструмент полезным? Помогите нам рассказать о нем.