AI를 위한 마크다운: LLM 워크플로우에 필수적인 이유

AI 도구를 조금만 다뤄 보면 한 가지 패턴이 눈에 들어옵니다. 프롬프트, 모델 카드, 검색용 원본 문서, 데이터셋 주석은 PDF나 워드보다 마크다운으로 작성되는 경우가 훨씬 많습니다. 이는 단순한 개발자의 습관이 아닙니다. 마크다운의 일반 텍스트 구조, 명확한 의미론적 표현, 그리고 보편적인 호환성은 사람이 읽을 수 있는 콘텐츠와 기계가 처리할 수 있는 데이터 사이에 자연스럽게 들어맞습니다.

이 가이드에서는 마크다운이 왜 AI 및 LLM 콘텐츠에 잘 맞는지, 그리고 언어 모델에서 더 나은 결과를 얻기 위해 어떻게 구조화해야 하는지를 설명합니다.

기초 이해하기

마크다운의 강점은 단순함입니다. 마크다운은 원본 그대로도 읽기 쉽고 HTML로 깔끔하게 변환되도록 설계된 경량 마크업 언어로 만들어졌습니다. AI 애플리케이션에서 그것을 유용하게 만드는 것은 바로 이 구조화된 단순함입니다.

머신러닝에서 일반 텍스트가 중요한 이유

PDF나 DOCX 같은 바이너리 형식과 달리 마크다운 파일은 순수한 텍스트입니다. 이는 AI 워크플로우에 실질적인 영향을 미칩니다.

- 직접 수집: 마크다운은 추출이나 전처리 단계 없이 언어 모델에 그대로 투입할 수 있습니다.

- 버전 관리: Git은 텍스트 기반의 차이점(diff)을 깔끔하게 처리하며, 이는 협업 데이터셋과 프롬프트 라이브러리에 중요합니다.

- 가벼운 저장 용량: 동일한 문서라도 워드나 PDF 파일보다 마크다운으로 저장하면 훨씬 작습니다.

- 보편적 호환성: 어떤 시스템이나 도구든 읽을 수 있습니다.

훈련 및 검색 파이프라인에서 이러한 단순성은 한 부류의 문제를 통째로 없애 줍니다. 독점 파서도 필요 없고, 스캔한 PDF에서 발생하는 추출 오류도 없습니다.

의미론적 구조

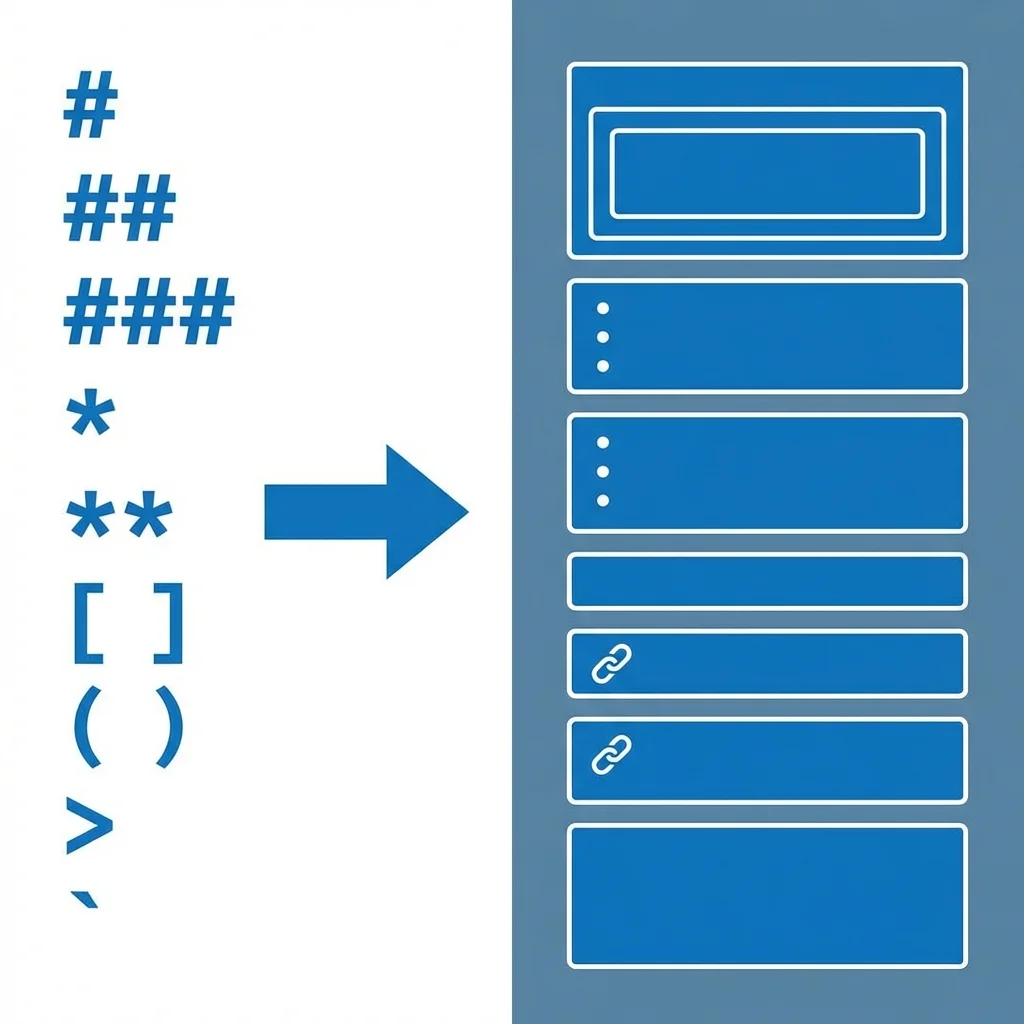

AI 관점에서 마크다운을 차별화하는 것은 그 의미론적 요소입니다. 헤더(#, ##, ###)는 명확한 계층 구조를 만들고, 리스트는 관련 항목을 묶어 주며, 코드 블록은 기술적인 내용을 분리합니다. 이는 단순한 시각적 서식이 아니라 구조적 신호입니다.

다음 예시를 보세요.

## Training Configuration

- Model: transformer-based

- Dataset size: 10M tokens

- Batch size: 32

### Hyperparameters

| Parameter | Value |

|-----------|-------|

| Learning rate | 0.001 |

| Epochs | 50 |

헤더는 주제의 경계를 표시하고, 리스트는 순차적인 정보를 제시하며, 표는 구조화된 데이터를 담습니다. 이를 읽는 모델은 산문만으로 구조를 추론할 필요 없이 콘텐츠가 어떻게 구성되어 있는지에 대한 명시적인 단서를 얻습니다.

언어 모델이 구조화된 콘텐츠를 처리하는 방식

언어 모델은 텍스트를 처리하기 전에 토큰으로 분해합니다. 마크다운의 구분 기호 — 강조를 위한 별표, 헤더를 위한 해시, 코드를 위한 백틱 — 는 그 토큰 스트림 안에서 일관되고 예측 가능한 표지가 됩니다.

신호로서의 구조

## Hyperparameters와 같은 헤더는 새로운 섹션이 시작된다는 것을 알리는 명확하고 일관된 표지입니다. 주요 모델 제공업체 — OpenAI와 Anthropic 모두 — 의 프롬프트 엔지니어링 지침은 모델에게 명확하게 구분되고 잘 구조화된 입력을 제공할 것을 권장합니다. 마크다운은 이를 실현하는 간단한 방법 중 하나입니다.

실제로 잘 구조화된 입력은 다음과 같은 점에 도움이 되는 경향이 있습니다.

- 주제 유지: 명확한 섹션은 모델이 응답의 범위를 유지하기 쉽게 해 줍니다.

- 맥락 유지: 헤더는 긴 문서에서 닻(anchor) 역할을 합니다.

- 지시 사항 준수: "맥락"과 "요구사항"을 분리하면 모호함이 줄어듭니다.

이는 보장이 아니라 경향입니다. 구조는 도움이 되지만, 잘 작성된 프롬프트를 대체하지는 못합니다.

계층 구조와 어텐션

트랜스포머 모델은 입력의 어느 부분이 작업에 가장 관련 있는지를 따져 봅니다. 일관된 H1 → H2 → H3 계층 구조는, 구분되지 않은 텍스트 덩어리보다 그 과정에 더 명확한 문서의 지도를 제공합니다.

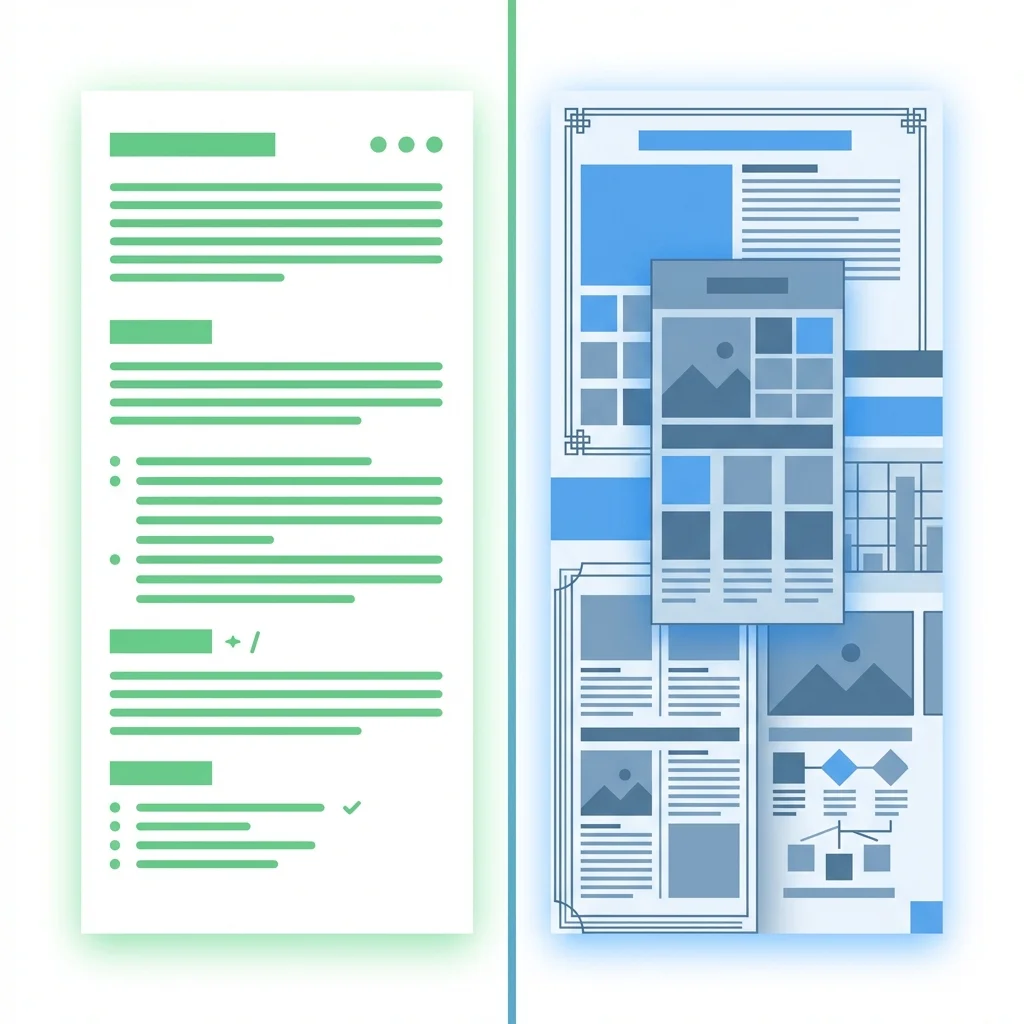

형식 비교

마크다운이 모든 작업에 적합한 선택은 아니지만, AI 워크플로우에서는 전통적인 문서 형식보다 분명한 이점을 가집니다. 아래 표는 일반적인 트레이드오프를 요약한 것입니다.

| 형식 | 편집 용이성 | 토큰 효율성 | 버전 관리 | AI 수집 용이성 |

|---|---|---|---|---|

| 마크다운 | 높음 | 높음 | 네이티브(일반 텍스트) | 직접 가능 |

| 낮음 | 낮음 | 어려움 | 추출 필요 | |

| DOCX | 보통 | 낮음 | 어려움(바이너리) | 추출 필요 |

| HTML | 보통 | 보통 | 가능 | 직접 가능하나 장황함 |

핵심은 신뢰성입니다. 바이너리 형식은 추출 단계를 필요로 하며, 바로 그 단계에서 구문 분석 오류가 스며듭니다. 이러한 오류는 훈련 데이터를 손상시키거나 모델에 깨진 입력을 줄 수 있습니다.

트레이드오프

마크다운에도 한계는 있습니다. 복잡한 레이아웃을 기본적으로 지원하지 않고, 미디어를 삽입하려면 외부 파일이 필요하며, 스타일링은 최소한입니다. AI 작업의 경우 이러한 미니멀리즘은 대체로 장점입니다. 콘텐츠가 본질에 집중하게 되기 때문입니다. 세련된 결과물이 필요할 때는 마크다운 to 워드 변환 도구 같은 도구를 사용해 마크다운으로 초안을 작성한 다음 전문적인 형식으로 내보낼 수 있습니다.

AI 콘텐츠를 위한 실용적인 마크다운 기능

언어 모델을 다룰 때 특히 유용한 몇 가지 마크다운 기능이 있습니다.

구조화된 데이터를 위한 표

마크다운 표는 표 형식의 정보를 모델이 직접 추론할 수 있는 형태로 제시합니다.

| Model | Context window | Structured input |

|-------|----------------|-------------------|

| Example A | Large | Handled well |

| Example B | Very large | Handled well |

이는 같은 데이터를 산문으로 설명하는 것보다 더 명확합니다. 모델은 특정 값을 추출하고 행을 비교할 수 있습니다. 표가 컨텍스트 창을 점유하지 않도록 적당히 짧게 유지하세요.

기술 콘텐츠를 위한 코드 블록

분리된 코드 블록(Fenced code blocks)은 코드를 주변 텍스트와 격리합니다.

```python

def train_model(data, epochs=50):

# Training logic here

return model

```

백틱 3개 펜스는 모델이 코드 구두점을 서술의 일부로 잘못 읽는 것을 방지합니다. 이는 코드를 생성하거나 API를 문서화할 때 중요합니다.

순차적 정보를 위한 리스트

순서 있는 리스트와 순서 없는 리스트는 서로 다른 관계를 나타냅니다.

- 순서 없는 리스트 (

-또는*)는 개념이나 기능의 묶음에 사용 - 순서 있는 리스트 (

1.,2.)는 순서대로 일어나는 단계에 사용

리스트 유형을 콘텐츠에 맞추면 모델이 의도한 순서대로 지시 사항을 따르는 데 도움이 됩니다.

AI 워크플로우에서 마크다운 사용하기

데이터셋 준비

주석 데이터를 처음부터 마크다운으로 구조화하면 읽기 쉽고 편집하기 쉬운 상태가 유지됩니다.

- 헤더를 사용해 범주나 예제를 구분합니다.

- 멀티턴 대화나 순차적 데이터에는 리스트를 사용합니다.

- 보이는 텍스트에 나타나서는 안 되는 메타데이터가 필요할 때는 HTML 주석(

<!-- key: value -->)에 숨겨진 맥락을 담습니다.

많은 주석 작업의 경우 이 방식이 원시 JSON이나 CSV보다 작성하고 검토하기 쉽습니다.

프롬프트 엔지니어링

마크다운은 프롬프트 템플릿에 명확한 형태를 부여합니다.

## Task: Summarize the following article

### Context

[Article text here]

### Requirements

- Length: 3-5 sentences

- Focus on key findings

- Maintain an objective tone

과제, 맥락, 요구사항을 라벨이 붙은 섹션으로 분리하면 모델이 지시 사항을 파싱하기 더 쉬워집니다.

문서화 및 모델 카드

마크다운은 모델 문서화의 표준입니다 — Hugging Face 모델 카드도 마크다운으로 작성됩니다. 표 안의 사양, 코드 블록 안의 예제, 설명 산문, 링크 형태의 인용을 모두 하나의 Git 친화적인 소스 파일 안에 결합할 수 있습니다.

최적화 팁

헤더 레벨을 일관되게 유지하기

헤더를 점진적으로 사용하세요 — H1에서 H3로 건너뛰지 마세요. 일관된 계층 구조는 문서의 구조를 명확하게 유지합니다. markdownlint 같은 린터는 CI 파이프라인에서 이를 자동으로 강제할 수 있습니다.

특수 문자 이스케이프

문법으로 해석될 수 있는 문자는 이스케이프하세요.

Use `\*` to display an asterisk literally

이는 모델 — 또는 다운스트림 파서 — 이 기호를 잘못 읽는 경우를 방지합니다.

컨텍스트 창 관리

LLM에는 토큰 제한이 있습니다. 마크다운 문서를 모듈식으로 유지하세요. 하나의 지나치게 큰 파일에 의존하기보다 긴 파일을 독립적으로 처리할 수 있는 섹션으로 나누세요.

피해야 할 일반적인 함정

자주 반복되는 몇 가지 실수는 주의해 둘 만합니다.

- 일관성 없는 공백: 탭과 공백을 섞어 쓰면 일부 파서가 고장 날 수 있습니다.

- 과도한 중첩: 3~4단계보다 깊은 리스트는 모델에게도 사람에게도 따라가기 어려워집니다.

- 이스케이프되지 않은 문자: 떠도는 기호가 파싱을 바꾸지 않도록 코드 블록을 검증하세요.

- 문법 불일치: 널리 지원되는 변형을 고수하세요 — CommonMark 사양과 GitHub Flavored Markdown이 가장 안전한 기준선입니다.

대규모 실행 전에 몇 가지 샘플 입력으로 테스트하면 이러한 문제 대부분을 일찍 잡아낼 수 있습니다.

마크다운이 향하는 방향

마크다운은 AI 작업의 요구를 계속 흡수하고 있습니다. Mermaid 문법은 다이어그램을 텍스트로 표현하고, YAML 프론트매터는 본문을 어지럽히지 않으면서 메타데이터를 담습니다. 둘 다 문서를 diff 가능하고 처리하기 쉬운 하나의 일반 텍스트 파일 안에 유지해 줍니다.

다른 것을 사용해야 할 때

마크다운이 항상 정답은 아닙니다. 시각적 요소가 많은 콘텐츠는 HTML이 더 나을 수 있습니다. 구조화된 데이터 교환은 보통 JSON이 낫습니다. 그리고 정밀한 서식이 필요한 최종 결과물이라면 워드나 PDF로 변환하세요 — 저희 무료 변환 도구가 그 단계를 처리합니다.

마크다운은 그것이 진정으로 뛰어난 곳에서 사용하세요. 초안 작성, 협업, 버전 관리, 그리고 언어 모델에 구조화된 콘텐츠를 투입하는 일입니다.

시작하기

마크다운이 아직 AI 워크플로우의 일부가 아니라면 작게 시작하세요.

- 다음 프롬프트 템플릿을 일반 텍스트 대신 마크다운으로 작성하세요.

- 작은 데이터셋을 헤더와 리스트로 구조화하세요.

- 평소 사용하는 모델로 실행하고 비구조화된 버전과 결과를 비교하세요.

익숙해지면 도움이 되는 곳에 표, 코드 블록, 메타데이터를 추가하세요.

전통적인 형식에서 벗어나는 팀에게는 하이브리드 접근 방식이 잘 맞습니다. 속도와 협업을 위해 마크다운으로 초안을 작성한 다음, 전달을 위해 세련된 형식으로 변환하는 것입니다. 저희 블로그에 이 워크플로우에 대한 더 많은 튜토리얼이 있습니다.

결론

AI와 머신러닝에서 마크다운의 인기는 개발 수명 주기 전반에 걸쳐 누적되는 실질적인 이점에서 비롯됩니다. 일반 텍스트의 단순성, 의미론적 구조, 보편적인 호환성이 그것입니다. 훈련 데이터, 프롬프트 템플릿, 모델 문서에 있어 마크다운은 신뢰할 수 있고 마찰이 적은 형식입니다.

학습 곡선은 작습니다. 한 프로젝트를 마크다운으로 구조화하고, 현재 방식과 비교한 다음, 결과가 결정하게 하세요.

이 도구가 유용한가요? 널리 공유해주세요.