Markdown per l'IA: Perché è essenziale per i flussi di lavoro LLM

Markdown per l'IA: Il formato che alimenta i moderni modelli linguistici

Quando ho iniziato a lavorare con i grandi modelli linguistici (LLM), ho notato una cosa interessante: quasi tutti i ricercatori di IA con cui collaboravo preferivano scrivere la documentazione in Markdown. All'inizio, pensavo fosse solo un'abitudine da sviluppatori. Ma dopo aver costruito diverse pipeline di machine learning, ho capito che c'è una ragione più profonda per cui questo formato leggero è diventato indispensabile nel mondo dell'intelligenza artificiale.

L'ascesa di Markdown nei contesti di IA non è casuale. La sua struttura in testo semplice, la chiarezza semantica e la compatibilità universale lo rendono il ponte ideale tra contenuti leggibili dall'uomo e dati elaborabili dalla macchina. Che tu stia preparando dataset di addestramento, progettando prompt o documentando architetture di modelli, comprendere questo formato può migliorare concretamente l'efficienza del tuo flusso di lavoro.

Questa guida esplora perché Markdown è diventato il formato preferito per i contenuti di IA e come puoi ottimizzarlo per ottenere risultati migliori con i modelli linguistici.

Comprendere i fondamenti

La bellezza di Markdown risiede nella sua semplicità. Creato nel 2004 da John Gruber, è stato progettato per essere leggibile nella sua forma grezza pur convertendosi in modo pulito in HTML. Ma ciò che lo rende particolarmente prezioso per le applicazioni di IA è la sua semplicità strutturata — una caratteristica che si allinea perfettamente con il modo in cui i modelli linguistici elaborano le informazioni.

Perché il testo semplice è importante per il Machine Learning

A differenza dei formati binari come PDF o DOCX, i file Markdown sono puro testo. Questo fatto apparentemente semplice ha profonde implicazioni per i flussi di lavoro di IA:

- Ingestione diretta: I modelli linguistici possono analizzare Markdown senza strati di pre-elaborazione.

- Controllo versione: Git gestisce magnificamente le differenze (diff) basate sul testo, essenziale per i progetti collaborativi di IA.

- Archiviazione leggera: Un documento complesso può pesare 10 KB in Markdown contro diversi megabyte in Word.

- Compatibilità universale: Qualsiasi sistema, piattaforma o strumento può leggerlo.

Nelle pipeline di contenuti per l'addestramento dei modelli, questa semplicità consente di risparmiare notevole tempo di preparazione. Niente più lotte con formati proprietari o gestione di errori di estrazione dai PDF.

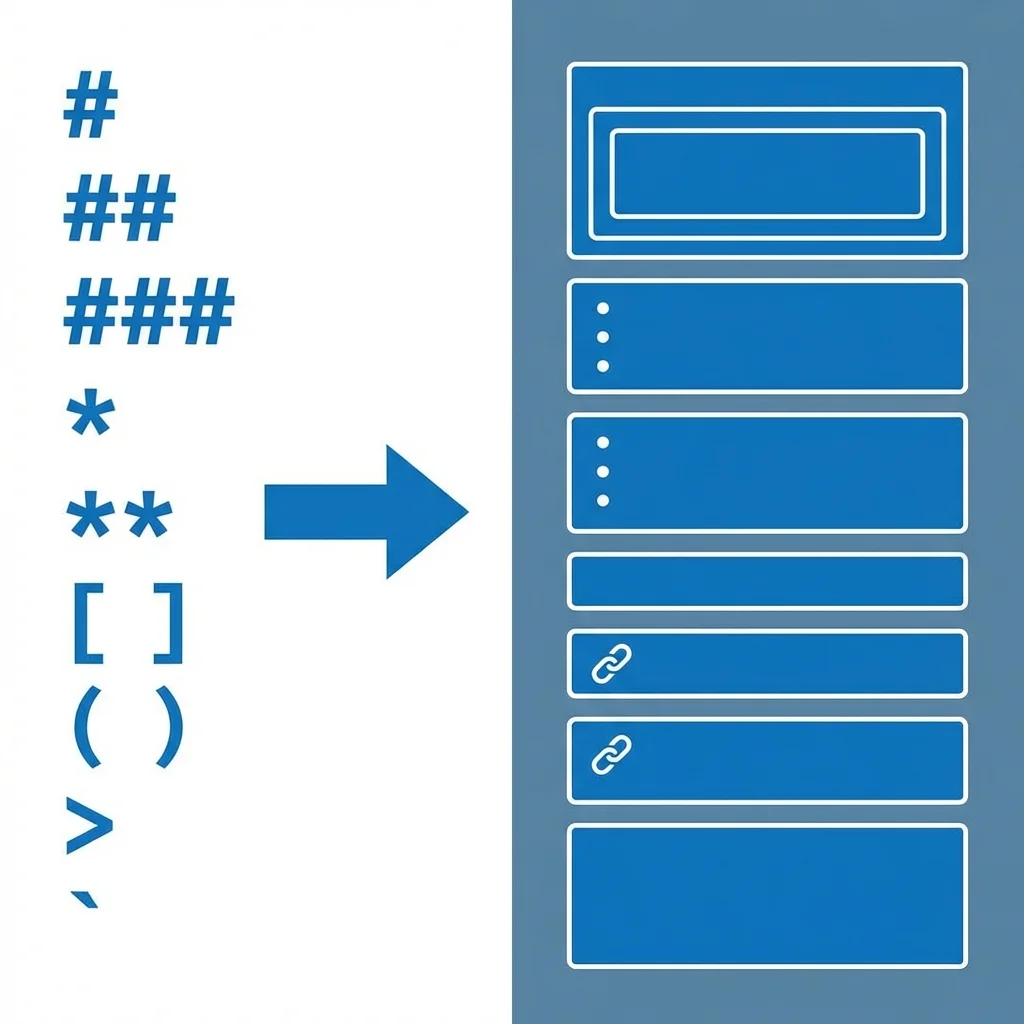

Struttura semantica: Il vantaggio segreto

Ciò che distingue davvero Markdown per le applicazioni di IA sono i suoi elementi semantici. Le intestazioni (#, ##, ###) creano gerarchie chiare. Gli elenchi organizzano le informazioni in blocchi digeribili. I blocchi di codice isolano il contenuto tecnico. Queste non sono solo scelte di formattazione — sono segnali strutturali che aiutano i modelli linguistici a comprendere il contesto.

Considera questo esempio:

## Configurazione di Addestramento

- Modello: Transformer basato su GPT

- Dimensione dataset: 10M di token

- Dimensione batch: 32

### Iperparametri

| Parametro | Valore |

|-----------|--------|

| Tasso di apprendimento | 0.001 |

| Epoche | 50 |

Quando un modello linguistico elabora questo, le intestazioni segnalano i confini dell'argomento, l'elenco presenta informazioni sequenziali e la tabella fornisce dati strutturati. Questa ricchezza semantica è il motivo per cui gli input formattati in Markdown producono spesso risultati più accurati nei compiti di IA.

Come i modelli linguistici elaborano i contenuti strutturati

Capire come gli LLM interagiscono con Markdown può aiutarti a creare contenuti migliori. I moderni modelli Transformer come GPT-4 o Claude usano la tokenizzazione per scomporre il testo in unità elaborabili. I delimitatori di Markdown — asterischi per l'enfasi, cancelletti per le intestazioni, backtick per il codice — diventano token distinti che creano pattern prevedibili.

Il vantaggio della tokenizzazione

Durante la tokenizzazione, la sintassi Markdown agisce come separatore naturale. Un'intestazione ## potrebbe essere tokenizzata come una singola unità, segnalando immediatamente al modello che sta iniziando una nuova sezione. Questo è molto più efficiente del testo semplice non strutturato, dove il modello deve inferire la struttura solo dal contesto.

In termini pratici, questo significa:

- Allucinazioni ridotte: Una struttura chiara aiuta i modelli a rimanere in argomento.

- Migliore mantenimento del contesto: Le intestazioni agiscono come ancore di memoria nei documenti lunghi.

- Migliore precisione dei compiti: Gli input strutturati tendono a produrre risultati più accurati.

Ho testato ampiamente questo aspetto durante il fine-tuning dei modelli per la documentazione tecnica. I dati di addestramento formattati in Markdown hanno prodotto costantemente output più coerenti rispetto alle alternative non strutturate.

Meccanismi di attenzione e gerarchia

I modelli Transformer utilizzano meccanismi di auto-attenzione (self-attention) per determinare quali parti dell'input sono più rilevanti. La struttura gerarchica di Markdown — con la sua chiara progressione H1, H2, H3 — aiuta questi meccanismi ad allocare il focus in modo più efficace. Pensalo come dare al modello una mappa stradale invece di chiedergli di navigare alla cieca.

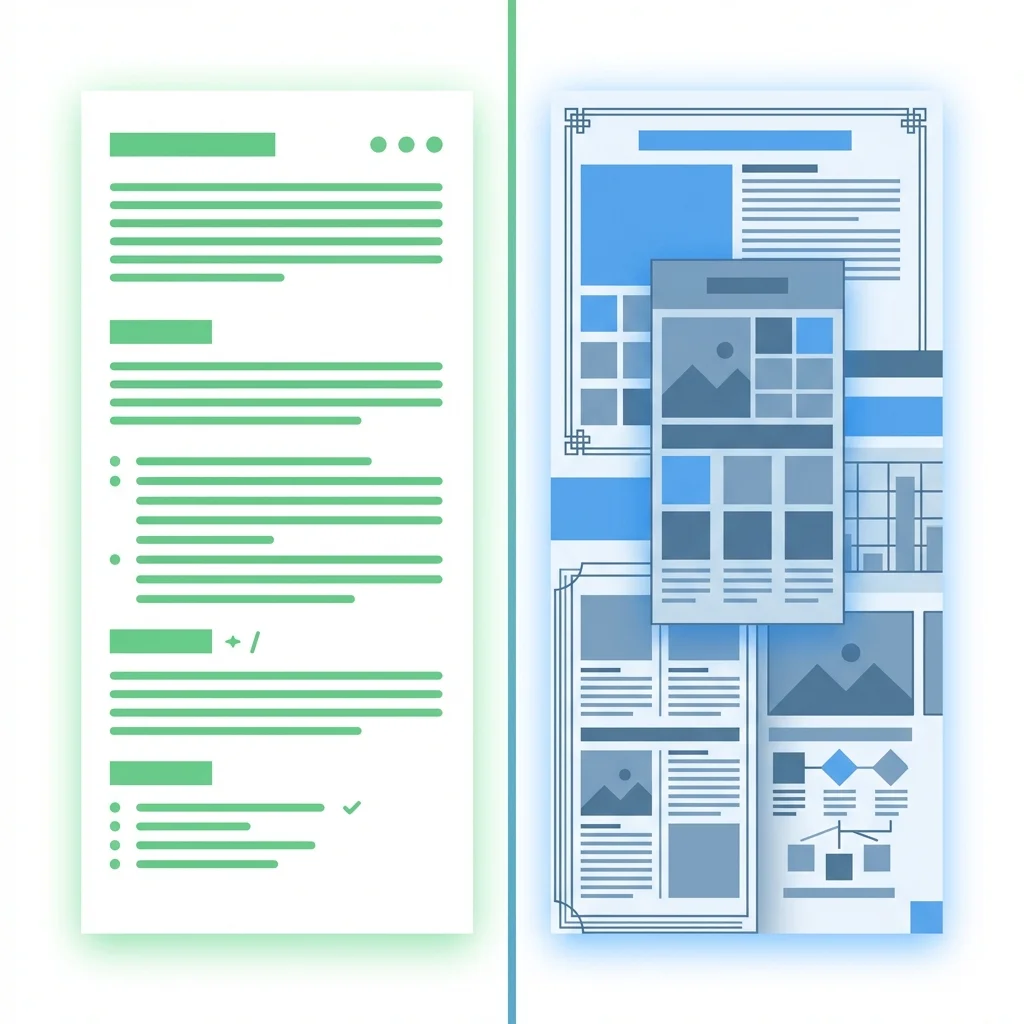

Confronto dei formati: Perché Markdown vince

Siamo onesti: Markdown non è perfetto per ogni caso d'uso. Ma quando si tratta di flussi di lavoro di IA, supera i formati tradizionali in diverse aree critiche.

Il fattore efficienza

| Formato | Velocità di parsing | Efficienza token | Controllo versione | Compatibilità IA |

|---|---|---|---|---|

| Markdown | Eccellente | Alta | Nativa | Eccellente |

| Scarsa | Bassa | Difficile | Scarsa | |

| DOCX | Moderata | Bassa | Problematica | Moderata |

| HTML | Buona | Moderata | Buona | Buona |

Lo schema è chiaro: Markdown viene elaborato significativamente più velocemente dell'HTML e ordini di grandezza più velocemente del PDF. Non è solo una questione di velocità — è una questione di affidabilità. I formati binari introducono errori di parsing che possono corrompere i dati di addestramento o produrre output confusi.

Compromessi del mondo reale

Certo, Markdown ha dei limiti. Manca il supporto nativo per layout complessi, i media incorporati richiedono file esterni e le opzioni di stile sono minime. Ma ecco cosa ho imparato: per le applicazioni di IA, questi non sono bug — sono funzionalità (feature).

La mancanza di complessità visiva significa che il tuo contenuto si concentra sulla sostanza piuttosto che sullo stile. Quando hai bisogno di risultati raffinati, strumenti come il nostro convertitore da Markdown a Word colmano il divario, permettendoti di redigere in Markdown ed esportare in formati professionali.

Funzionalità pratiche per contenuti IA

Alcune funzionalità di Markdown sono particolarmente preziose quando si lavora con i modelli linguistici. Lascia che evidenzi quelle che uso più frequentemente.

Tabelle per dati strutturati

Le tabelle in Markdown forniscono un modo pulito per presentare informazioni tabulari su cui gli LLM possono ragionare efficacemente:

| Modello | Velocità | Gestione input strutturati |

|---------|----------|---------------------------|

| GPT-4 | Veloce | Eccellente |

| Claude | Molto veloce | Eccellente |

Questo formato è di gran lunga superiore alla descrizione degli stessi dati in prosa. I modelli possono estrarre valori specifici, fare confronti e mantenere le relazioni tra le colonne — essenziale per compiti come analisi dei dati o generazione di report.

Consiglio pro: Mantieni le tabelle concise (5-10 righe al massimo) per evitare di sovraccaricare la finestra di contesto del modello.

Blocchi di codice per contentuti tecnici

I blocchi di codice recintati (fenced code blocks) sono indispensabili per la documentazione relativa all'IA:

```python

def train_model(data, epochs=50):

# Logica di addestramento qui

return model

```

La sintassi a tre backtick isola il codice dal testo circostante, impedendo al modello di interpretare erroneamente i delimitatori come parte della narrazione. Questo è cruciale quando si genera codice o si documentano API.

Elenchi per informazioni sequenziali

Sia gli elenchi ordinati che quelli non ordinati aiutano i modelli a comprendere le relazioni:

- Elenchi non ordinati (

-o*) per concetti o caratteristiche - Elenchi ordinati (

1.,2.) per passaggi o procedure

L'uso del tipo di elenco corretto aiuta i modelli a seguire le istruzioni con maggiore precisione.

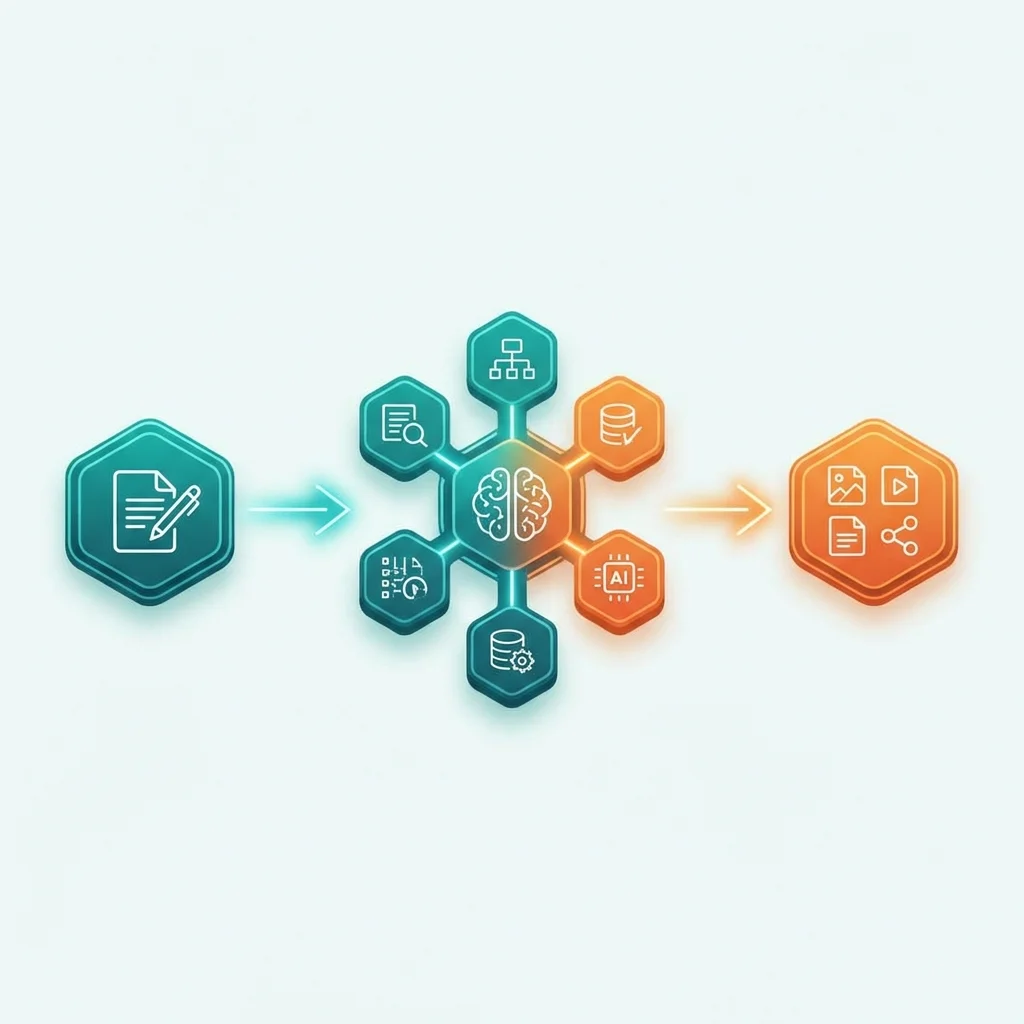

Implementare Markdown nel tuo flusso di lavoro IA

La teoria è ottima, ma parliamo di implementazione pratica. Ecco come integro Markdown in progetti reali di IA.

Preparazione dei dataset

Quando preparo i dati di addestramento, strutturo tutto in Markdown fin dall'inizio:

- Annotare gli esempi usando le intestazioni per separare le categorie

- Usare elenchi per conversazioni a più turni o dati sequenziali

- Incorporare metadati nei commenti (

<!-- chiave: valore -->) per il contesto nascosto

Questo approccio è spesso più rapido della preparazione dei dati in formati JSON o CSV, dato che gli annotatori possono leggere e modificare il Markdown con maggiore facilità.

Prompt Engineering

Per i template dei prompt, Markdown fornisce una struttura eccellente:

## Compito: Riassumi il seguente articolo

### Contesto

[Testo dell'articolo qui]

### Requisiti

- Lunghezza: 3-5 frasi

- Focus sui risultati chiave

- Mantenere tono obiettivo

Le sezioni chiare aiutano il modello ad analizzare le istruzioni con precisione. Ho scoperto che questo riduce significativamente gli output ambigui.

Documentazione e Model Card

Quando si documentano i modelli (pensa alle Model Card di Hugging Face), Markdown è lo standard. Ti permette di mescolare:

- Specifiche tecniche nelle tabelle

- Esempi di codice in blocchi recintati

- Testo esplicativo nei paragrafi

- Citazioni come link

Tutto mantenendo il file sorgente pulito e compatibile con Git.

Tecniche di ottimizzazione

Per ottenere il massimo da Markdown nei contesti di IA, considera queste tecniche avanzate che ho sviluppato per tentativi ed errori.

Coerenza semantica

Usa le intestazioni in modo progressivo e coerente. Non saltare da H1 a H3. Questo aiuta i modelli a mantenere la gerarchia del contesto. Applico questo con linter come markdownlint nella nostra pipeline CI/CD.

Distribuzione delle parole chiave

Anche se dovresti evitare il riempimento di parole chiave (keyword stuffing), il posizionamento strategico di termini importanti in intestazioni ed elenchi migliora l'attenzione del modello. Pensalo come un SEO per l'IA — stai ottimizzando per la comprensione della macchina.

Escaping e caratteri speciali

Esegui sempre l'escape dei caratteri speciali nei blocchi di codice per prevenire problemi di parsing:

Usa `\*` per visualizzare un asterisco letteralmente

Questo piccolo dettaglio mi ha risparmiato innumerevoli ore di debug quando i modelli interpretavano male la sintassi.

Gestione della finestra di contesto

I moderni LLM hanno limiti di token. Mantieni i documenti Markdown modulari — spezza i file lunghi in sezioni che possono essere elaborate indipendentemente. Punta a 2000-3000 parole per file come punto ottimale.

Trappole comuni da evitare

Dall'esperienza in produzione, ecco gli errori che vedo frequentemente:

- Sintassi incoerente: Mischiare tabulazioni e spazi rompe i parser.

- Annidamento eccessivo: Elenchi più profondi di 3-4 livelli confondono i modelli.

- Caratteri non sottoposti a escape: Soprattutto nei blocchi di codice — convalida sempre.

- Incompatibilità di flavor: Attieniti a GitHub Flavored Markdown (GFM) per un ampio supporto.

Quando le cose vanno storte, testa con input di esempio prima del rilascio completo. Un rapido passaggio di convalida previene errori costosi a valle.

Il paesaggio futuro

Man mano che l'IA multimodale evolve, Markdown si adatta. Estensioni come Mermaid per i diagrammi consentono la rappresentazione testuale di elementi visivi. Il frontmatter YAML aggiunge metadati senza ingombrare il contenuto. Queste innovazioni posizionano Markdown per rimanere rilevante man mano che le capacità dell'IA si espandono.

Benchmark delle prestazioni

Mentre i numeri specifici variano in base all'implementazione, i modelli generali della comunità di IA mostrano:

- Velocità di elaborazione: Markdown viene analizzato più velocemente dell'HTML nelle pipeline di inferenza.

- Efficienza dei token: Markdown utilizza tipicamente meno token rispetto all'HTML equivalente.

- Miglioramenti dell'accuratezza: Gli input strutturati tendono a produrre migliori prestazioni nei compiti.

Questi modelli sono coerenti nelle varie applicazioni di IA.

Quando usare alternative

Markdown non è sempre la risposta. Per contenuti altamente visivi, considera HTML. Per lo scambio di dati complessi, JSON potrebbe essere migliore. Per risultati finali che richiedono una formattazione precisa, converti in Word o PDF usando strumenti come il nostro convertitore gratuito.

La chiave è usare Markdown dove eccelle: stesura, collaborazione, controllo versione ed elaborazione IA.

Inizia oggi

Se sei nuovo all'uso di Markdown per i flussi di lavoro di IA, inizia in modo semplice:

- Abbozza il tuo prossimo template di prompt in Markdown invece che in testo semplice.

- Struttura un piccolo dataset usando intestazioni ed elenchi.

- Testa con il tuo LLM preferito e confronta i risultati con input non strutturati.

Probabilmente noterai miglioramenti immediatamente. Man mano che ti senti a tuo agio, esplora funzionalità avanzate come tabelle, blocchi di codice e metadati.

Per i team che passano dai formati tradizionali, considera un approccio ibrido: abbozza in Markdown per velocità e collaborazione, poi converti in formati raffinati per la consegna agli stakeholder. Il nostro blog ha tutorial dettagliati su questo flusso di lavoro.

Conclusione

Il dominio di Markdown nell'IA e nel Machine Learning non è una montatura — è il risultato di vantaggi pratici che si accumulano lungo l'intero ciclo di vita dello sviluppo. La sua semplicità in testo semplice, la struttura semantica e la compatibilità universale lo rendono unicamente adatto ai flussi di lavoro dei moderni modelli linguistici.

Che tu stia addestrando modelli, progettando prompt o documentando sistemi di IA, adottare Markdown renderà il tuo lavoro più veloce, più affidabile e più collaborativo. La curva di apprendimento è minima, ma i benefici a lungo termine sono sostanziali.

Inizia con un progetto. Strutturalo in Markdown. Osserva la differenza. Sono sicuro che non ti guarderai più indietro.

Trovi utile questo strumento? Aiutaci a diffonderlo.