Markdown pour l'IA : pourquoi c'est essentiel aux workflows LLM

Passez un peu de temps autour des outils d'IA et un schéma ressort : les prompts, les model cards, les documents sources pour la recherche et les annotations de jeux de données sont écrits en Markdown bien plus souvent qu'en PDF ou en Word. Ce n'est pas seulement une habitude de développeurs. La structure en texte brut du Markdown, sa clarté sémantique et sa compatibilité universelle en font un format naturellement adapté à la jonction entre le contenu lisible par l'humain et les données traitables par la machine.

Ce guide explique pourquoi le Markdown fonctionne bien pour le contenu d'IA et de LLM, et comment le structurer pour obtenir de meilleurs résultats avec les modèles de langage.

Comprendre les fondamentaux

La force du Markdown réside dans sa simplicité. Il a été créé comme un langage de balisage léger, conçu pour être lisible sous sa forme brute tout en se convertissant proprement en HTML. Pour les applications d'IA, c'est précisément cette simplicité structurée qui le rend utile.

Pourquoi le texte brut compte pour le Machine Learning

Contrairement aux formats binaires comme le PDF ou le DOCX, un fichier Markdown est du pur texte. Cela a de réelles conséquences pour les workflows d'IA :

- Ingestion directe : le Markdown peut être fourni à un modèle de langage sans aucune étape d'extraction ou de prétraitement.

- Contrôle de version : Git gère proprement les différences (diffs) basées sur le texte, ce qui compte pour les jeux de données collaboratifs et les bibliothèques de prompts.

- Stockage léger : le même document est bien plus petit en Markdown qu'en fichier Word ou PDF.

- Compatibilité universelle : n'importe quel système ou outil peut le lire.

Pour les pipelines d'entraînement et de recherche, cette simplicité élimine toute une catégorie de problèmes : pas de parseurs propriétaires, pas d'erreurs d'extraction depuis des PDF numérisés.

Structure sémantique

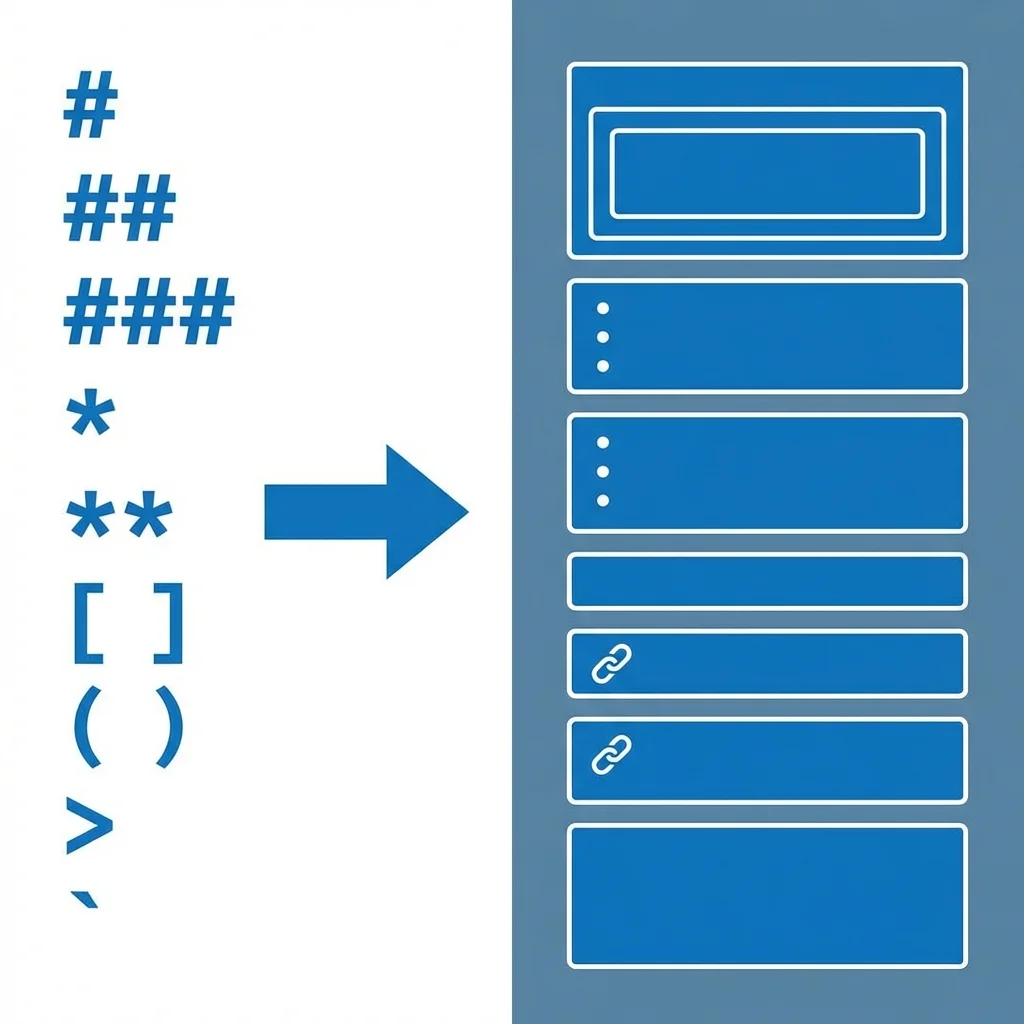

Ce qui distingue le Markdown pour l'IA, ce sont ses éléments sémantiques. Les titres (#, ##, ###) créent une hiérarchie claire, les listes regroupent des éléments connexes et les blocs de code isolent le contenu technique. Ce sont des signaux structurels, pas seulement du formatage visuel.

Considérez cet exemple :

## Training Configuration

- Model: transformer-based

- Dataset size: 10M tokens

- Batch size: 32

### Hyperparameters

| Parameter | Value |

|-----------|-------|

| Learning rate | 0.001 |

| Epochs | 50 |

Les titres marquent les limites des sujets, la liste présente des informations séquentielles et le tableau contient des données structurées. Un modèle qui lit cela dispose d'indices explicites sur l'organisation du contenu, plutôt que de devoir déduire la structure à partir de la seule prose.

Comment les modèles de langage traitent le contenu structuré

Les modèles de langage découpent le texte en tokens avant de le traiter. Les délimiteurs du Markdown — astérisques pour l'emphase, dièses pour les titres, accents graves pour le code — sont des marqueurs cohérents et prévisibles au sein de ce flux de tokens.

La structure comme signal

Un titre comme ## Hyperparameters est un marqueur clair et cohérent indiquant qu'une nouvelle section commence. Les guides de prompt engineering des principaux fournisseurs de modèles — aussi bien OpenAI qu'Anthropic — recommandent de fournir aux modèles des entrées clairement délimitées et bien structurées. Le Markdown est une façon simple de le faire.

En pratique, une entrée bien structurée tend à aider à :

- Rester sur le sujet : des sections claires permettent à un modèle de mieux cadrer sa réponse.

- Conserver le contexte : les titres servent d'ancres dans les longs documents.

- Suivre les instructions : séparer le « contexte » des « exigences » réduit l'ambiguïté.

Ce sont des tendances, pas des garanties : la structure aide, mais ne remplace pas un prompt bien rédigé.

Hiérarchie et attention

Les modèles Transformer pondèrent les parties de l'entrée les plus pertinentes pour la tâche. Une hiérarchie cohérente H1 → H2 → H3 donne à ce processus une carte plus claire du document qu'un mur de texte indifférencié.

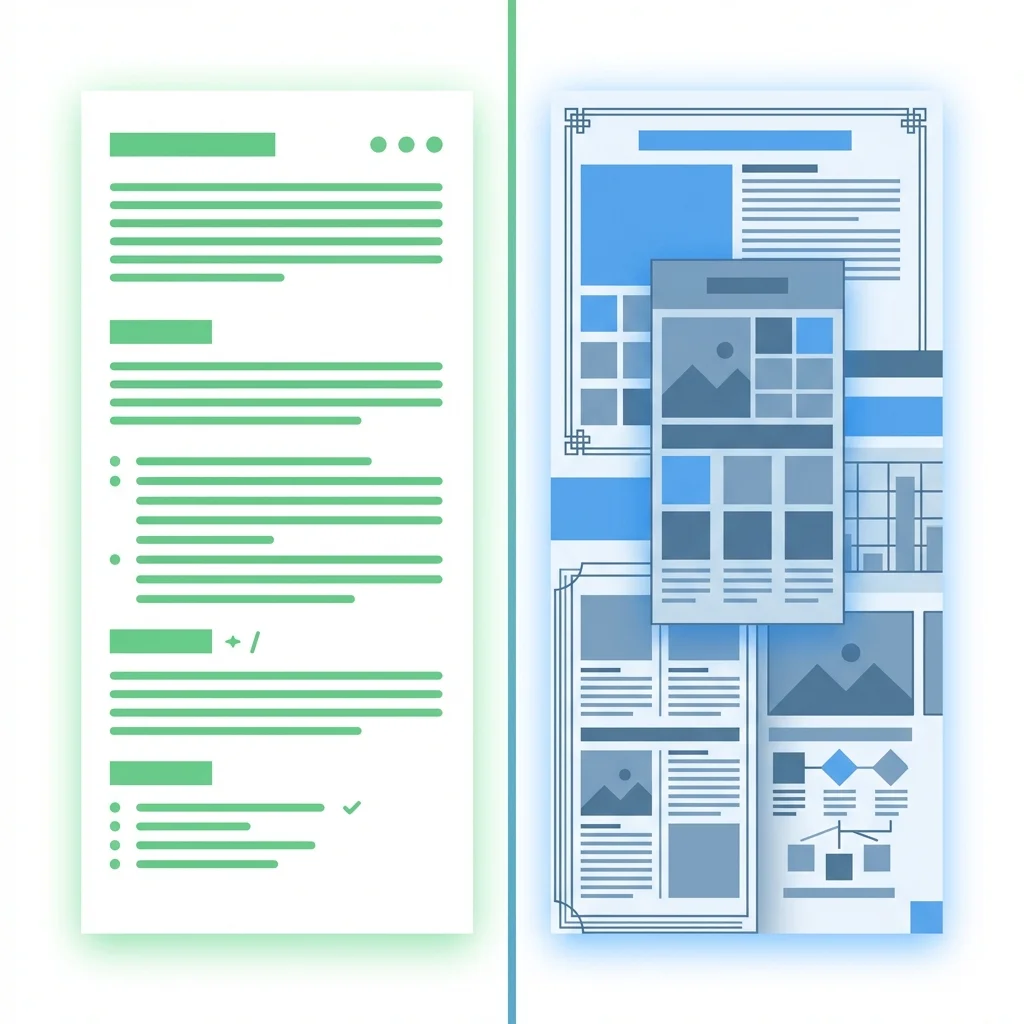

Comparaison des formats

Le Markdown n'est pas le bon choix pour chaque tâche, mais pour les workflows d'IA il présente des avantages nets sur les formats de document traditionnels. Le tableau ci-dessous résume les compromis généraux :

| Format | Facilité d'édition | Efficacité des tokens | Contrôle de version | Facilité d'ingestion par l'IA |

|---|---|---|---|---|

| Markdown | Élevée | Élevée | Natif (texte brut) | Directe |

| Faible | Faible | Difficile | Extraction nécessaire | |

| DOCX | Modérée | Faible | Difficile (binaire) | Extraction nécessaire |

| HTML | Modérée | Modérée | Praticable | Directe, mais verbeuse |

L'essentiel, c'est la fiabilité. Les formats binaires nécessitent une étape d'extraction, et c'est à cette étape que se glissent les erreurs d'analyse — des erreurs qui peuvent corrompre les données d'entraînement ou fournir au modèle une entrée brouillée.

Compromis

Le Markdown a bien des limites : pas de support natif pour les mises en page complexes, les médias intégrés nécessitent des fichiers externes et le style est minimal. Pour le travail avec l'IA, ce minimalisme est surtout un avantage : le contenu reste concentré sur le fond. Lorsque vous avez besoin d'un livrable soigné, un outil comme notre convertisseur Markdown vers Word vous permet de rédiger en Markdown et d'exporter vers un format professionnel.

Fonctionnalités Markdown pratiques pour le contenu d'IA

Quelques fonctionnalités du Markdown sont particulièrement utiles lorsque l'on travaille avec des modèles de langage.

Tableaux pour les données structurées

Un tableau Markdown présente des informations tabulaires sous une forme sur laquelle un modèle peut raisonner directement :

| Model | Context window | Structured input |

|-------|----------------|-------------------|

| Example A | Large | Handled well |

| Example B | Very large | Handled well |

C'est plus clair que de décrire les mêmes données en prose : un modèle peut extraire des valeurs précises et comparer des lignes. Gardez les tableaux raisonnablement courts pour qu'ils ne dominent pas la fenêtre contextuelle.

Blocs de code pour le contenu technique

Les blocs de code délimités isolent le code du texte environnant :

```python

def train_model(data, epochs=50):

# Training logic here

return model

```

La délimitation par trois accents graves empêche le modèle d'interpréter la ponctuation du code comme du texte narratif — important lors de la génération de code ou de la documentation d'API.

Listes pour l'information séquentielle

Les listes ordonnées et non ordonnées signalent des relations différentes :

- Listes non ordonnées (

-ou*) pour des ensembles de concepts ou de fonctionnalités - Listes ordonnées (

1.,2.) pour des étapes qui se déroulent en séquence

Faire correspondre le type de liste au contenu aide un modèle à suivre les instructions dans l'ordre prévu.

Utiliser le Markdown dans un workflow d'IA

Préparation des jeux de données

Structurer les données d'annotation en Markdown dès le départ les garde lisibles et modifiables :

- Utilisez des titres pour séparer les catégories ou les exemples.

- Utilisez des listes pour les conversations à plusieurs tours ou les données séquentielles.

- Conservez le contexte caché dans des commentaires HTML (

<!-- key: value -->) lorsque vous avez besoin de métadonnées qui ne doivent pas apparaître dans le texte visible.

Pour de nombreuses tâches d'annotation, c'est plus facile à écrire et à relire que du JSON ou du CSV brut.

Prompt engineering

Le Markdown donne aux modèles de prompts une forme claire :

## Task: Summarize the following article

### Context

[Article text here]

### Requirements

- Length: 3-5 sentences

- Focus on key findings

- Maintain an objective tone

Séparer la tâche, le contexte et les exigences en sections étiquetées rend les instructions plus faciles à analyser pour un modèle.

Documentation et model cards

Le Markdown est le standard de la documentation de modèles — les model cards de Hugging Face y sont rédigées. Il permet de combiner des spécifications dans des tableaux, des exemples dans des blocs de code, de la prose explicative et des citations sous forme de liens, le tout dans un seul fichier source compatible avec Git.

Conseils d'optimisation

Gardez des niveaux de titre cohérents

Utilisez les titres de manière progressive — ne sautez pas de H1 à H3. Une hiérarchie cohérente garde la structure du document sans ambiguïté. Un linter comme markdownlint peut imposer cela automatiquement dans un pipeline CI.

Échappez les caractères spéciaux

Échappez les caractères qui seraient autrement interprétés comme de la syntaxe :

Use `\*` to display an asterisk literally

Cela évite les cas où un modèle — ou un parseur en aval — interprète mal le symbole.

Gérez la fenêtre contextuelle

Les LLM ont des limites de tokens. Gardez les documents Markdown modulaires : découpez les longs fichiers en sections qui peuvent être traitées indépendamment, plutôt que de dépendre d'un seul fichier surdimensionné.

Pièges courants à éviter

Quelques erreurs récurrentes méritent une attention particulière :

- Espacement incohérent : mélanger tabulations et espaces peut casser certains parseurs.

- Imbrication excessive : les listes de plus de trois ou quatre niveaux de profondeur deviennent difficiles à suivre — pour les modèles comme pour les humains.

- Caractères non échappés : validez les blocs de code pour que des symboles parasites ne modifient pas l'analyse.

- Incompatibilité de variantes : tenez-vous-en à une variante largement prise en charge — la spécification CommonMark et le GitHub Flavored Markdown sont les bases les plus sûres.

Tester avec quelques entrées d'exemple avant un traitement à grande échelle permet de repérer la plupart de ces problèmes tôt.

Vers où se dirige le Markdown

Le Markdown continue d'absorber les besoins du travail avec l'IA. La syntaxe Mermaid représente les diagrammes sous forme de texte, et le frontmatter YAML transporte des métadonnées sans encombrer le corps du document. Les deux gardent les documents dans un seul fichier en texte brut qui reste comparable (diff-able) et facile à traiter.

Quand utiliser autre chose

Le Markdown n'est pas toujours la réponse. Un contenu très visuel peut être mieux servi en HTML. L'échange de données structurées est généralement préférable en JSON. Et pour un livrable final qui nécessite un formatage précis, convertissez vers Word ou PDF — notre convertisseur gratuit prend en charge cette étape.

Utilisez le Markdown là où il excelle vraiment : rédaction, collaboration, contrôle de version et alimentation des modèles de langage en contenu structuré.

Premiers pas

Si le Markdown ne fait pas encore partie de votre workflow d'IA, commencez petit :

- Rédigez votre prochain modèle de prompt en Markdown plutôt qu'en texte brut.

- Structurez un petit jeu de données avec des titres et des listes.

- Passez-le dans votre modèle habituel et comparez les résultats avec une version non structurée.

À mesure que vous gagnez en aisance, ajoutez des tableaux, des blocs de code et des métadonnées là où ils aident.

Pour les équipes qui s'éloignent des formats traditionnels, une approche hybride fonctionne bien : rédiger en Markdown pour la rapidité et la collaboration, puis convertir vers un format soigné pour la livraison. Notre blog propose d'autres tutoriels sur ce workflow.

Conclusion

La popularité du Markdown dans l'IA et le machine learning vient d'avantages pratiques qui s'additionnent tout au long du cycle de développement : simplicité du texte brut, structure sémantique et compatibilité universelle. Pour les données d'entraînement, les modèles de prompts et la documentation de modèles, c'est un format fiable et à faible friction.

La courbe d'apprentissage est faible. Structurez un projet en Markdown, comparez-le à votre approche actuelle, et laissez les résultats décider.

Vous trouvez cet outil utile ? Aidez-nous à le faire connaître.