ChatGPT Markdown-Ausgabe meistern: Wichtige Prompts & Tipps

Möchten Sie, dass ChatGPT jedes Mal gut formatierte Inhalte liefert? Der Schlüssel liegt darin, wie Sie es prompten. Dieser Leitfaden zeigt, wie Sie ChatGPT dazu bringen, mit praktischen Prompting-Techniken konsistente, strukturierte Markdown-Antworten zu generieren.

Egal, ob Sie als Entwickler technische Dokumentationen schreiben oder als Content Creator Blogbeiträge verfassen – zu wissen, wie man die Formatierung von ChatGPT steuert, macht seine Ausgabe deutlich einfacher wiederverwendbar. Wir behandeln praktische Prompts, Formatierungstechniken und wie Sie diese Ausgabe in professionelle Dokumente überführen.

Warum ChatGPT standardmäßig Markdown produziert

ChatGPT neigt aus einem einfachen Grund zu Markdown: Es ist eine leichtgewichtige Auszeichnungssprache, die Struktur hinzufügt – Überschriften, Listen, Code-Blöcke – ohne den Ballast von HTML oder eines proprietären Formats. Das macht eine Antwort sowohl als Reintext als auch im gerenderten Zustand lesbar.

Was dahintersteckt

Große Sprachmodelle werden auf enormen Textmengen trainiert, und ein großer Teil technischer Inhalte – GitHub-Repositories, Dokumentationsseiten, Entwicklerforen – ist in Markdown geschrieben. Ein Modell, das so viel Markdown ausgesetzt war, neigt natürlich dazu, es auch zu produzieren, insbesondere bei technischen oder anleitenden Antworten.

Es gibt auch einen praktischen Nutzen: Markdown ist abhängigkeitsfrei. Ausgabe, die bereits in Markdown vorliegt, lässt sich ohne zusätzliche Verarbeitung direkt in Tools wie Pandoc, einen statischen Website-Generator oder ein Jupyter Notebook einfügen.

Warum die Struktur hilft

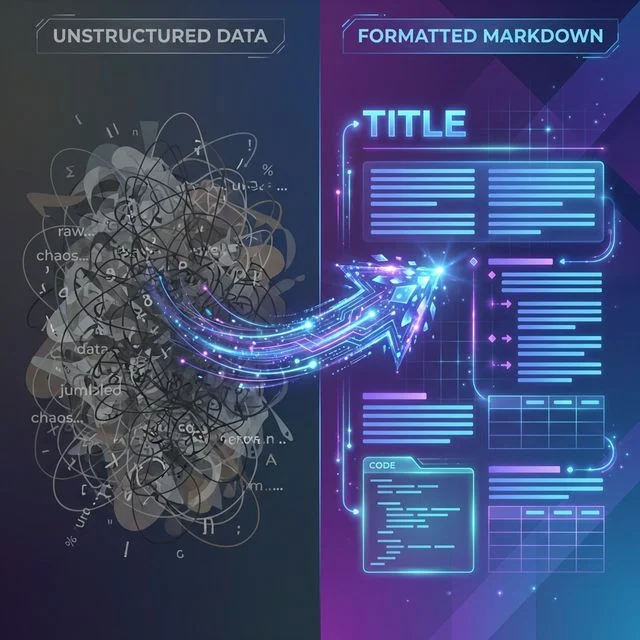

Unstrukturierter Reintext führt tendenziell zu dichten "Textwüsten"-Antworten, die die nützlichen Teile verbergen. Markdown fügt Hierarchie hinzu:

- Überschriften, um Abschnitte zu trennen

- Aufzählungszeichen für Listen

- Eingezäunte Code-Blöcke für Snippets

Diese Struktur macht eine Antwort einfacher zu überfliegen, einfacher in der Versionskontrolle zu diffen und für Screenreader generell zugänglicher als Ad-hoc-Formatierung. Nicht jedes Modell formatiert auf dieselbe Weise – kleinere oder ältere Modelle benötigen möglicherweise explizite Formatierungsanweisungen, wo ChatGPT oft von selbst Struktur hinzufügt.

Die Markdown-Ausgabe von ChatGPT verstehen

Um das Beste aus dem Markdown von ChatGPT herauszuholen, hilft es, ungefähr zu wissen, was es kann und was nicht. Wenn Sie nach einer strukturierten Antwort fragen, fügt das Modell Syntax wie # für Überschriften oder - für Listen ein, basierend auf den Mustern, die es während des Trainings gelernt hat. Es ist zuverlässig bei gängigen Elementen und weniger bei Randfällen.

Unterstützte Markdown-Funktionen

ChatGPT beherrscht den Großteil von GitHub Flavored Markdown (GFM), das einfaches Markdown um Tabellen, Aufgabenlisten und Durchstreichungen erweitert. Zum Beispiel kann es Folgendes ausgeben:

## Sample Heading

- Item 1

- Item 2 with **bold** text

| Column 1 | Column 2 |

|----------|----------|

| Data A | Data B |

```python

def hello():

print("World")

```

Eine praktische Grenze: Sehr lange oder komplexe Tabellen können in umfangreichen Antworten abgeschnitten werden, daher lohnt es sich, generierte Tabellen kompakt zu halten.

Häufige Elemente in Antworten

ChatGPT bildet Ihre Absicht auf Syntax ab. Fragen Sie nach einer "Schritt-für-Schritt-Anleitung", und es liefert in der Regel eine nummerierte Liste; fragen Sie nach einer Erklärung, erhalten Sie Absätze. Fett (**text**) und Kursiv (*text*) heben Schlüsselbegriffe hervor.

Es handhabt außerdem:

- Inline-Code (

`code`) für Variablen und kurze Snippets - Blockzitate (

> quote) für Hervorhebungen - Links als

[anchor](URL)

Wenn Sie striktes, parser-sicheres Markdown benötigen, reduziert die explizite Aufforderung nach "striktem Markdown" kleine Inkonsistenzen wie unregelmäßiges Escaping.

Reintext vs. Markdown

Eine Reintext-Erklärung etwa eines Algorithmus kann sich über Hunderte von Wörtern ohne visuelle Pausen erstrecken, was sie schwer nachvollziehbar macht. Derselbe Inhalt in Markdown verwendet Unterüberschriften und Listen, um die Informationen zu portionieren, was die Lesbarkeit generell verbessert.

Der Unterschied ist auch beim Tooling von Bedeutung: Die konsistenten Trennzeichen von Markdown machen es deutlich einfacher, zuverlässig zu parsen und zu konvertieren als freie Prosa. Der wichtigste Vorbehalt ist die Erweiterungsunterstützung – GFM-Tabellen funktionieren gut, aber speziellere Syntax (Fußnoten, benutzerdefinierte Emojis) wird möglicherweise nicht überall gerendert.

Wie man konsistente Markdown-Ausgabe erhält

Konsistentes Markdown läuft auf klares Prompting hinaus. Platzieren Sie Ihre Formatierungsanweisung früh im Prompt, damit sie die gesamte Antwort prägt.

Mit einer einfachen Anweisung beginnen

Eine grundlegende Anweisung wie "Antworte im Markdown-Format" setzt eine Basislinie. Zum Beispiel:

Prompt: "Erkläre REST APIs im Markdown-Format."

Typische Ausgabe:

# REST APIs Explained

REST (Representational State Transfer) is an architectural style for web services.

## Key Principles

- **Stateless**: Each request contains all the information needed.

- **Client-Server**: Separation of concerns.

Das Hinzufügen von "verwende Überschriften und Listen" schärft das Ergebnis weiter, sodass selbst kurze Antworten strukturiert statt als einfacher Absatz zurückkommen.

Für spezifische Funktionen verfeinern

Um bestimmte Elemente gezielt anzusprechen, seien Sie spezifisch:

Beispiel: "Generiere eine Markdown-Tabelle zum Vergleich von Python-Frameworks, inklusive Links zur Dokumentation."

Dies liefert eine Tabelle mit Ankerlinks, z. B. [Django](https://docs.djangoproject.com/).

Für mehrteilige Ausgaben verketten Sie Prompts: Fragen Sie zuerst nach dem Inhalt und bitten Sie das Modell dann, ihn neu zu formatieren. Ein paar nützliche Gewohnheiten:

- Geben Sie "GitHub Flavored Markdown" an, wenn Sie Tabellen oder Aufgabenlisten benötigen.

- Iterieren Sie mit kurzen Korrekturen wie "Mache die Listen zu Aufzählungslisten."

- Halten Sie einzelne Anfragen vernünftig eingegrenzt, damit lange Antworten nicht mitten im Format abgeschnitten werden.

Prompt-Beispiele für Markdown-Ausgabe

Nachfolgend Beispiel-Prompts, geordnet von einfach bis fortgeschritten.

Grundlegende Prompts

Für Routineaufgaben liefern diese schnelle, formatierte Ausgaben:

Artikel schreiben

Write a short article on JavaScript closures in Markdown.

Liefert Überschriften, fettgedruckte Schlüsselbegriffe und Code-Blöcke.

Aufgabenlisten

Create a to-do list for deploying a Node.js app in Markdown with checkboxes.

Liefert GFM-Aufgabenlisten: - [ ] Install dependencies

Zusammenfassungen

Summarize quantum computing basics in Markdown bullets.

Liefert eine überfliegbare Aufzählungsliste.

Fragen & Antworten

Answer: What is OAuth? Use Markdown headings.

Strukturiert die Antwort unter Überschriften wie # Overview und ## Flow.

Brainstorming

List 5 blog ideas for AI ethics in Markdown.

Liefert eine saubere, hierarchische Liste.

Fortgeschrittene Prompts

Für technische Ausgaben verketten Sie Prompts, um Komplexität aufzubauen:

Code-Dokumentation:

First, write a Python sorting algorithm. Then format the explanation

in Markdown with fenced code blocks, a table for Big O complexity,

and a link to the CPython docs.

Typische Ausgabe:

## Quicksort Implementation

```python

def quicksort(arr):

if len(arr) <= 1:

return arr

pivot = arr[len(arr) // 2]

left = [x for x in arr if x < pivot]

middle = [x for x in arr if x == pivot]

right = [x for x in arr if x > pivot]

return quicksort(left) + middle + quicksort(right)

```

### Complexity Analysis

| Operation | Time Complexity | Space Complexity |

|-----------|-----------------|------------------|

| Best | O(n log n) | O(log n) |

| Average | O(n log n) | O(log n) |

| Worst | O(n²) | O(n) |

See [CPython sorting docs](https://docs.python.org/3/howto/sorting.html) for details.

Datentabellen mit Mathematik:

Generate a Markdown table of ML model benchmarks,

and include LaTeX notation for any equations.

Dies treibt GFM weiter – Inline-LaTeX wie $E = mc^2$ wird nach der Konvertierung als Gleichung gerendert.

Best Practices für zuverlässige Ausgabe

Konsistente Ergebnisse zu erzielen deckt sich mit allgemeinen Ratschlägen zum Prompt Engineering: klar sein, spezifisch sein und iterieren. Sowohl OpenAI als auch Anthropic veröffentlichen lesenswerte Prompt-Engineering-Leitfäden, wenn Sie dies häufiger tun.

Konsistenz über eine Sitzung hinweg wahren

Wenn Sie die API nutzen, fixiert ein System-Prompt das Format:

You are a Markdown expert. Always respond in well-structured Markdown.

Niedrigere Temperatureinstellungen (etwa 0,2–0,5) reduzieren Variation, und eine sinnvolle Max-Token-Obergrenze verhindert, dass Antworten mitten im Format abgeschnitten werden. In der Weboberfläche hält das Wiederholen der Anweisung – "formatiere die Antwort in Markdown" – lange Konversationen davon ab, zurück zu Reintext abzudriften.

Fehlerbehebung bei inkonsistenten Antworten

Teilweise Formatierung, etwa fehlende Code-Zäune, entsteht in der Regel durch eine mehrdeutige Anfrage. Ein paar Lösungen:

- Hängen Sie "put all code in triple backticks" an, wenn Zäune fehlen.

- Fordern Sie bei zu langen Listen "concise Markdown" an.

- Wenn die Antwort Sprachen vermischt, geben Sie "respond in English Markdown" an.

ChatGPT-Markdown in Word konvertieren

Das Markdown von ChatGPT ergibt einen großartigen Entwurf, aber viele Teams benötigen für Review und Freigabe weiterhin ein Word-Dokument. Die Konvertierung überbrückt diese Lücke.

Warum in Word konvertieren

Markdown eignet sich für das Entwerfen und die Versionskontrolle; Word eignet sich für die Zusammenarbeit, mit Änderungsverfolgung und vertrautem Styling. Ein Konverter, der GFM unterstützt, überführt Überschriften, Tabellen, Code-Blöcke und sogar LaTeX-Gleichungen in eine .docx ohne manuelle Neuformatierung – und Word kann dann automatisch ein Inhaltsverzeichnis aus den Markdown-Überschriften generieren.

Für eine Einführung in die Syntax selbst, siehe unser Tutorial Wie man in Markdown schreibt.

Schritt-für-Schritt-Konvertierung

- Kopieren Sie die Markdown-Ausgabe von ChatGPT.

- Öffnen Sie den Markdown-zu-Word-Konverter.

- Einfügen oder Hochladen Ihres Markdowns – GFM-Tabellen und Code-Blöcke werden unterstützt.

- Herunterladen der

.docx; Fett, Links und Tabellen werden intakt übertragen. - In Word öffnen für letzte Anpassungen.

Der Prozess verarbeitet LaTeX-Mathematik und dauert für ein typisches Dokument nur wenige Sekunden.

Anwendungen in der Praxis

Die Markdown-Ausgabe von ChatGPT fügt sich natürlich in Content-Pipelines ein, vom ersten Entwurf bis zur Veröffentlichung.

Blog-Schreib-Workflow

Ein typischer Ablauf: ChatGPT prompten – "entwirf einen Beitrag über KI-Prompting in Markdown" – einen strukturierten Entwurf erhalten, ihn über das Markdown-zu-Word-Tool konvertieren, ihn in Word polieren und dann veröffentlichen. Der Vorteil ist eine von Anfang an konsistente Struktur, sodass weniger Zeit in die Neuformatierung und mehr in den eigentlichen Inhalt fließt. Das direkte Einfügen von rohem Markdown in manche CMS-Editoren zerstört die Formatierung, sodass das vorherige Konvertieren das vermeidet.

Technische Dokumentation

Für Entwickler-Guides kann ChatGPT Markdown-Skelette für READMEs und API-Dokumentationen generieren, mit Tabellen für Parameter und Benchmarks. Von dort aus können Sie Markdown in PDF konvertieren für finale Lieferobjekte oder Markdown in HTML für das Web-Publishing. Da Markdown modular ist, bedeutet das spätere Aktualisieren eines Abschnitts nicht, dass das gesamte Dokument neu formatiert werden muss.

Häufige Fallstricke und wie man sie vermeidet

Das Markdown von ChatGPT ist stark in der Struktur, aber ein paar Prompting-Fehler treten wiederholt auf.

Häufige Prompting-Fehler

- Über-Spezifikation: Nach Dingen zu fragen, die Markdown nicht kann – "verwende blaue Links", "genau 5 Überschriften in 12pt" – führt zu inkonsistenten Ergebnissen. Bleiben Sie bei dem, was die Syntax unterstützt.

- Vage Anfragen: "Liste die Vor- und Nachteile auf" liefert möglicherweise Reintext; "gib mir eine Markdown-Tabelle der Vor- und Nachteile mit den Spalten X, Y, Z" liefert eine echte Tabelle.

- Kein Sprach-Tag am Code: Fordern Sie immer einen Sprachbezeichner an, damit Code-Blöcke getaggt werden (

python statt eines bloßen).

Prototypisieren Sie mit kurzen Prompts und iterieren Sie, bevor Sie sich auf einen langen verlassen.

Markdown vs. andere Formate

Markdown ist nicht für alles die Antwort. Es eignet sich gut für textlastige, erzählerische Ausgaben und konvertiert sauber in andere Dokumentformate. Für den strukturierten Datenaustausch ist JSON besser geeignet; für interaktive Oberflächen brauchen Sie tatsächlichen UI-Code. Wählen Sie Markdown dort, wo seine Stärken – Lesbarkeit, Portabilität, einfache Konvertierung – tatsächlich von Bedeutung sind.

Häufig gestellte Fragen

F: Kann ich dies mit Claude oder anderen KI-Modellen verwenden?

A: Ja. Derselbe Markdown-Prompting-Ansatz funktioniert mit jeder KI, die Text formatiert – fragen Sie einfach nach "output in Markdown format".

F: Wie bewahre ich Fett- und Kursivformatierung?

A: Markdown verwendet **bold**, *italic* und ***bold italic***, was ChatGPT nativ produziert und was in die entsprechende Word-Formatierung konvertiert wird.

F: Was ist mit mathematischen Formeln?

A: Fordern Sie LaTeX-Notation an – z. B. "explain the quadratic formula using LaTeX in Markdown" – und ChatGPT liefert $$\frac{-b \pm \sqrt{b^2-4ac}}{2a}$$, was in eine korrekte Gleichung konvertiert wird.

F: Gibt es ein Längenlimit?

A: Das Kontextfenster von ChatGPT hängt vom Modell ab. Arbeiten Sie bei sehr langen Dokumenten in Abschnitten und kombinieren Sie sie anschließend.

F: Funktioniert das für Tabellen?

A: Ja. Fragen Sie nach "a comparison table in Markdown format" und geben Sie die Spalten an; die Ausgabe ist GFM-konform und konvertiert sauber.

Verwandte Ressourcen

- Markdown-zu-Word-Leitfaden: Ein vollständiges Konvertierungs-Tutorial

- Markdown zu PDF: Direkt in PDF konvertieren für finale Lieferobjekte

- Markdown zu HTML: Web-fertige Inhalte erstellen

- Wie man in Markdown schreibt: Die Syntax von Grund auf lernen

Fazit

Die Markdown-Ausgabe von ChatGPT zu steuern, geht hauptsächlich darum, bewusst zu prompten: explizit nach Markdown fragen, die benötigten Elemente angeben und iterieren, wenn das Ergebnis abdriftet. Kombinieren Sie das mit einem zuverlässigen Konverter, und die Ausgabe des Modells wird zu einem echten ersten Entwurf für Dokumentationen, Artikel und Berichte – nicht zu etwas, das Sie von Hand neu formatieren müssen.

Bereit, es einzusetzen? Probieren Sie unseren kostenlosen Markdown-zu-Word-Konverter mit Ihrer nächsten ChatGPT-Antwort.

Finden Sie dieses Tool nützlich? Helfen Sie uns, es zu verbreiten.