Markdown para IA: Por qué es esencial en flujos de trabajo con LLM

Basta con dedicar algo de tiempo a las herramientas de IA para notar un patrón: los prompts, las model cards, los documentos fuente para recuperación y las anotaciones de conjuntos de datos se escriben en Markdown mucho más a menudo que en PDF o Word. Y no es solo un hábito de desarrolladores. La estructura de texto plano de Markdown, su claridad semántica y su compatibilidad universal lo convierten en un encaje natural entre el contenido legible por humanos y los datos procesables por máquinas.

Esta guía explica por qué Markdown funciona bien para el contenido de IA y LLM, y cómo estructurarlo para obtener mejores resultados con los modelos de lenguaje.

Entendiendo los fundamentos

La fortaleza de Markdown es su simplicidad. Fue creado como un lenguaje de marcado ligero, pensado para ser legible en su forma original mientras se convierte limpiamente a HTML. Para las aplicaciones de IA, esa simplicidad estructurada es justamente lo que lo hace útil.

Por qué el texto plano importa para el Machine Learning

A diferencia de los formatos binarios como PDF o DOCX, un archivo Markdown es texto puro. Eso tiene consecuencias reales para los flujos de trabajo de IA:

- Ingesta directa: Markdown puede entregarse a un modelo de lenguaje sin ningún paso de extracción o preprocesamiento.

- Control de versiones: Git maneja limpiamente las diferencias (diffs) basadas en texto, algo que importa en conjuntos de datos colaborativos y bibliotecas de prompts.

- Almacenamiento ligero: El mismo documento es mucho más pequeño como Markdown que como archivo de Word o PDF.

- Compatibilidad universal: Cualquier sistema o herramienta puede leerlo.

Para los pipelines de entrenamiento y recuperación, esa simplicidad elimina toda una clase de problemas: sin analizadores propietarios, sin errores de extracción de PDFs escaneados.

Estructura semántica

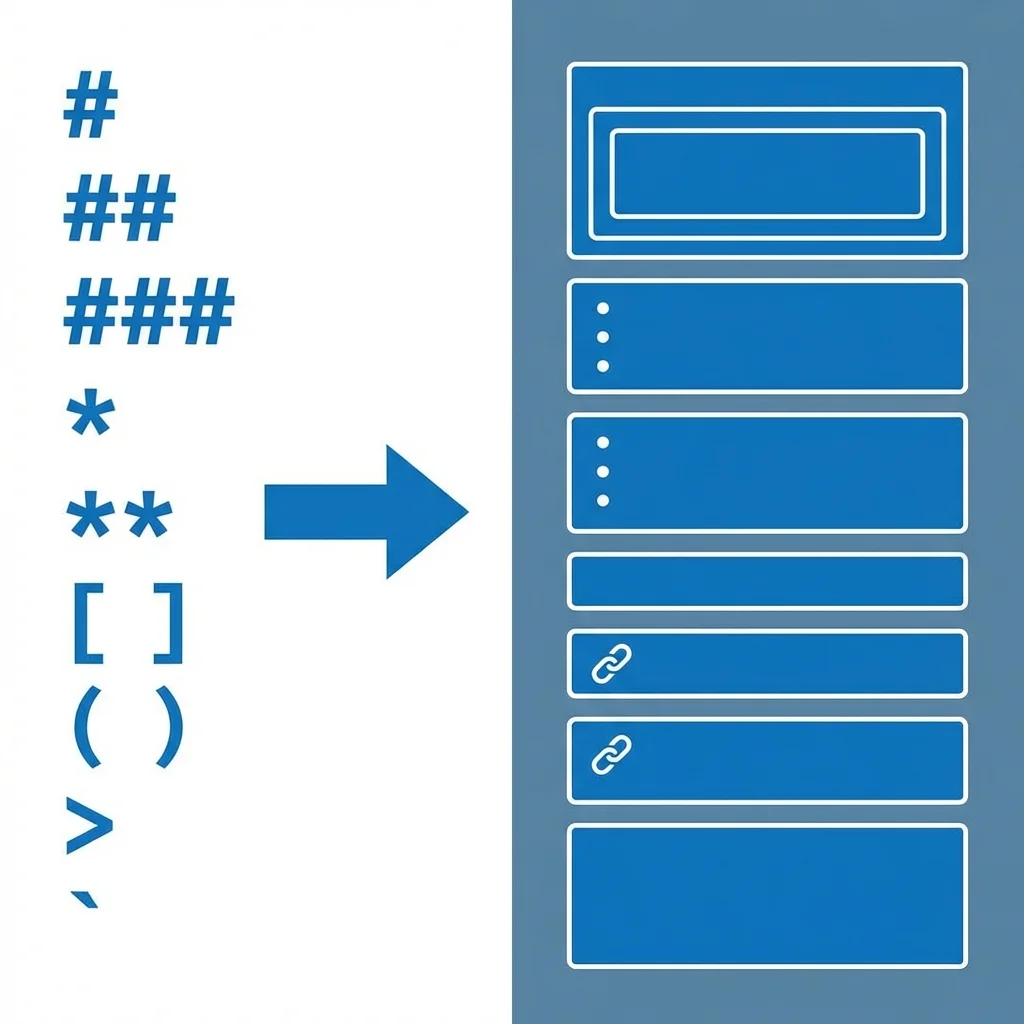

Lo que distingue a Markdown para la IA son sus elementos semánticos. Los encabezados (#, ##, ###) crean una jerarquía clara, las listas agrupan elementos relacionados y los bloques de código aíslan el contenido técnico. Son señales estructurales, no solo formato visual.

Considera este ejemplo:

## Training Configuration

- Model: transformer-based

- Dataset size: 10M tokens

- Batch size: 32

### Hyperparameters

| Parameter | Value |

|-----------|-------|

| Learning rate | 0.001 |

| Epochs | 50 |

Los encabezados marcan los límites de los temas, la lista presenta información secuencial y la tabla contiene datos estructurados. Un modelo que lee esto recibe pistas explícitas sobre cómo está organizado el contenido, en lugar de tener que inferir la estructura solo a partir de la prosa.

Cómo los modelos de lenguaje procesan el contenido estructurado

Los modelos de lenguaje descomponen el texto en tokens antes de procesarlo. Los delimitadores de Markdown —asteriscos para énfasis, almohadillas para encabezados, acentos graves para código— son marcadores consistentes y predecibles dentro de ese flujo de tokens.

La estructura como señal

Un encabezado como ## Hyperparameters es un marcador claro y consistente de que comienza una nueva sección. Las guías de ingeniería de prompts de los principales proveedores de modelos —tanto OpenAI como Anthropic— recomiendan dar a los modelos entradas claramente delimitadas y bien estructuradas. Markdown es una forma sencilla de hacerlo.

En la práctica, una entrada bien estructurada suele ayudar con:

- Mantenerse en el tema: Las secciones claras facilitan que un modelo acote el alcance de su respuesta.

- Retención del contexto: Los encabezados actúan como anclas en documentos largos.

- Seguimiento de instrucciones: Separar el "contexto" de los "requisitos" reduce la ambigüedad.

Son tendencias, no garantías: la estructura ayuda, pero no sustituye a un prompt bien redactado.

Jerarquía y atención

Los modelos Transformer ponderan qué partes de la entrada son más relevantes para la tarea. Una jerarquía consistente H1 → H2 → H3 le da a ese proceso un mapa más claro del documento que un muro de texto indiferenciado.

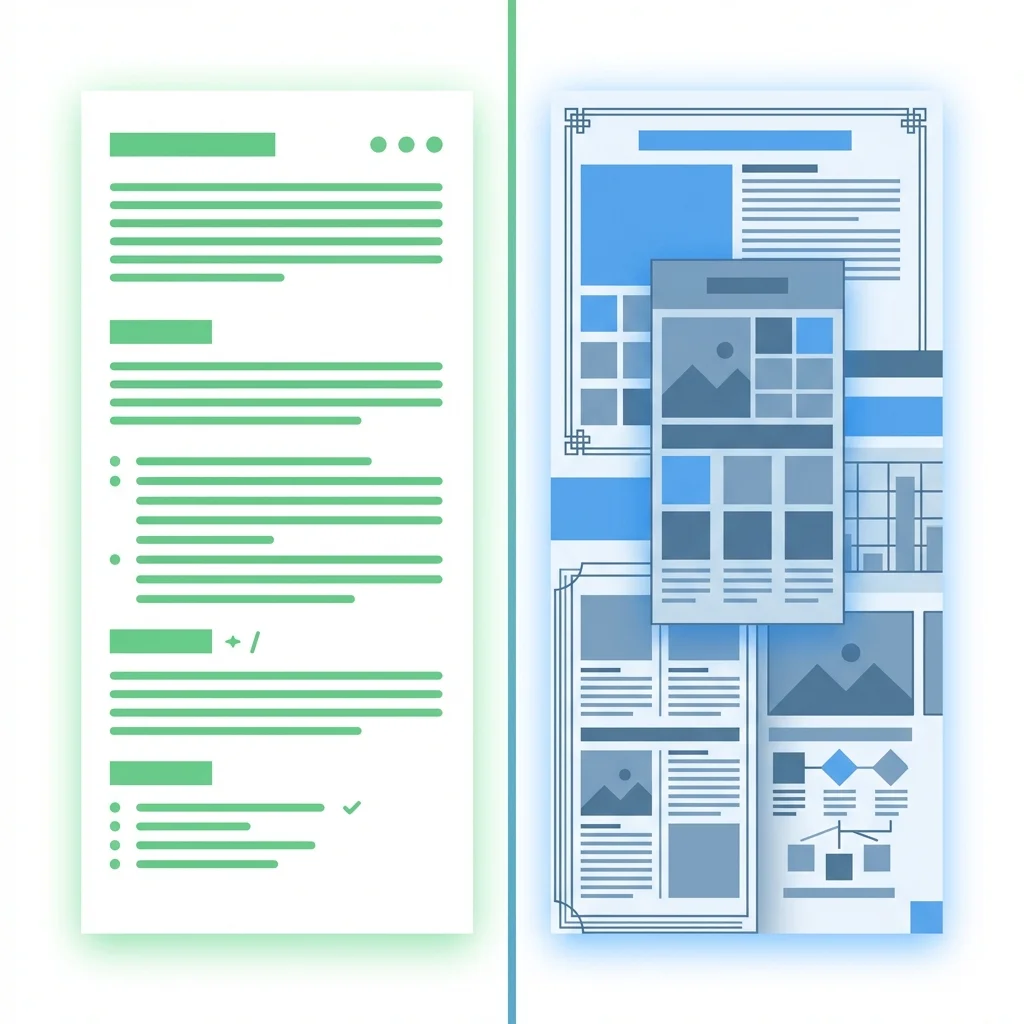

Comparación de formatos

Markdown no es la opción adecuada para todos los trabajos, pero para los flujos de trabajo de IA tiene ventajas claras sobre los formatos de documento tradicionales. La siguiente tabla resume los compromisos generales:

| Formato | Editabilidad | Eficiencia de tokens | Control de versiones | Facilidad de ingesta por IA |

|---|---|---|---|---|

| Markdown | Alta | Alta | Nativo (texto plano) | Directa |

| Baja | Baja | Difícil | Requiere extracción | |

| DOCX | Moderada | Baja | Difícil (binario) | Requiere extracción |

| HTML | Moderada | Moderada | Viable | Directa, pero verbosa |

El punto central es la fiabilidad. Los formatos binarios necesitan un paso de extracción, y ese paso es donde se cuelan los errores de análisis: errores que pueden corromper datos de entrenamiento o alimentar al modelo con entradas confusas.

Compromisos

Markdown sí tiene límites: no hay soporte nativo para diseños complejos, los medios integrados requieren archivos externos y el estilo es mínimo. Para el trabajo con IA, ese minimalismo es en su mayoría una ventaja: el contenido se mantiene centrado en la sustancia. Cuando necesitas un entregable pulido, una herramienta como nuestro convertidor de Markdown a Word te permite redactar en Markdown y exportar a un formato profesional.

Características prácticas de Markdown para contenido de IA

Algunas características de Markdown son especialmente útiles al trabajar con modelos de lenguaje.

Tablas para datos estructurados

Una tabla en Markdown presenta información tabular en una forma sobre la que un modelo puede razonar directamente:

| Model | Context window | Structured input |

|-------|----------------|-------------------|

| Example A | Large | Handled well |

| Example B | Very large | Handled well |

Esto es más claro que describir los mismos datos en prosa: un modelo puede extraer valores específicos y comparar filas. Mantén las tablas razonablemente cortas para que no dominen la ventana de contexto.

Bloques de código para contenido técnico

Los bloques de código cercados aíslan el código del texto que lo rodea:

```python

def train_model(data, epochs=50):

# Training logic here

return model

```

El cercado de tres acentos graves evita que el modelo malinterprete la puntuación del código como narrativa, algo importante al generar código o documentar APIs.

Listas para información secuencial

Las listas ordenadas y desordenadas señalan relaciones distintas:

- Listas desordenadas (

-o*) para conjuntos de conceptos o características - Listas ordenadas (

1.,2.) para pasos que ocurren en secuencia

Hacer coincidir el tipo de lista con el contenido ayuda a un modelo a seguir las instrucciones en el orden previsto.

Usar Markdown en un flujo de trabajo de IA

Preparación de conjuntos de datos

Estructurar los datos de anotación en Markdown desde el principio los mantiene legibles y editables:

- Usa encabezados para separar categorías o ejemplos.

- Usa listas para conversaciones de múltiples turnos o datos secuenciales.

- Mantén el contexto oculto en comentarios HTML (

<!-- key: value -->) cuando necesites metadatos que no deban aparecer en el texto visible.

Para muchas tareas de anotación, esto es más fácil de escribir y revisar que JSON o CSV en bruto.

Ingeniería de prompts

Markdown le da a las plantillas de prompts una forma clara:

## Task: Summarize the following article

### Context

[Article text here]

### Requirements

- Length: 3-5 sentences

- Focus on key findings

- Maintain an objective tone

Separar la tarea, el contexto y los requisitos en secciones etiquetadas hace que las instrucciones sean más fáciles de analizar para un modelo.

Documentación y model cards

Markdown es el estándar para la documentación de modelos: las model cards de Hugging Face están escritas en él. Permite combinar especificaciones en tablas, ejemplos en bloques de código, prosa explicativa y citas como enlaces, todo en un único archivo fuente compatible con Git.

Consejos de optimización

Mantén consistentes los niveles de encabezado

Usa los encabezados de forma progresiva: no saltes de H1 a H3. Una jerarquía consistente mantiene inequívoca la estructura del documento. Un linter como markdownlint puede aplicar esto automáticamente en un pipeline de CI.

Escapa los caracteres especiales

Escapa los caracteres que de otro modo se interpretarían como sintaxis:

Use `\*` to display an asterisk literally

Esto evita los casos en que un modelo —o un analizador posterior— malinterpreta el símbolo.

Gestiona la ventana de contexto

Los LLM tienen límites de tokens. Mantén los documentos Markdown modulares: divide los archivos largos en secciones que puedan procesarse de forma independiente, en lugar de depender de un único archivo demasiado grande.

Errores comunes a evitar

Conviene estar atento a algunos errores recurrentes:

- Espaciado inconsistente: Mezclar tabulaciones y espacios puede romper algunos analizadores.

- Anidamiento excesivo: Las listas con más de tres o cuatro niveles de profundidad se vuelven difíciles de seguir, tanto para los modelos como para las personas.

- Caracteres sin escapar: Valida los bloques de código para que los símbolos sueltos no alteren el análisis.

- Incompatibilidad de variantes: Apégate a una variante ampliamente soportada: la especificación CommonMark y GitHub Flavored Markdown son las bases más seguras.

Probar con unas pocas entradas de muestra antes de una ejecución grande detecta la mayoría de estos problemas a tiempo.

Hacia dónde se dirige Markdown

Markdown sigue absorbiendo las necesidades del trabajo con IA. La sintaxis Mermaid representa diagramas como texto, y el frontmatter YAML transporta metadatos sin saturar el cuerpo. Ambos mantienen los documentos en un único archivo de texto plano que sigue siendo comparable (diff-able) y fácil de procesar.

Cuándo usar otra cosa

Markdown no siempre es la respuesta. El contenido muy visual puede quedar mejor como HTML. El intercambio de datos estructurados suele estar mejor como JSON. Y para un entregable final que necesita un formato preciso, convierte a Word o PDF: nuestro convertidor gratuito se encarga de ese paso.

Usa Markdown donde realmente sobresale: redacción, colaboración, control de versiones y alimentar contenido estructurado a los modelos de lenguaje.

Primeros pasos

Si Markdown aún no forma parte de tu flujo de trabajo de IA, empieza con algo pequeño:

- Escribe tu próxima plantilla de prompt en Markdown en lugar de texto plano.

- Estructura un pequeño conjunto de datos con encabezados y listas.

- Pásalo por tu modelo habitual y compara los resultados con una versión sin estructurar.

A medida que te sientas cómodo, añade tablas, bloques de código y metadatos donde resulten útiles.

Para los equipos que se están alejando de los formatos tradicionales, un enfoque híbrido funciona bien: redactar en Markdown por velocidad y colaboración, y luego convertir a un formato pulido para la entrega. Nuestro blog tiene más tutoriales sobre ese flujo de trabajo.

Conclusión

La popularidad de Markdown en la IA y el aprendizaje automático proviene de ventajas prácticas que se acumulan a lo largo de todo el ciclo de vida del desarrollo: simplicidad de texto plano, estructura semántica y compatibilidad universal. Para los datos de entrenamiento, las plantillas de prompts y la documentación de modelos, es un formato fiable y de baja fricción.

La curva de aprendizaje es pequeña. Estructura un proyecto en Markdown, compáralo con tu enfoque actual y deja que los resultados decidan.

¿Te resulta útil esta herramienta? Ayúdanos a difundirla.